Understanding Gender Bias in AI-Generated Product Descriptions

“사이즈4는 대부분에게 완벽” – 의류 설명 14%에서 발견된 체형 배제 언어

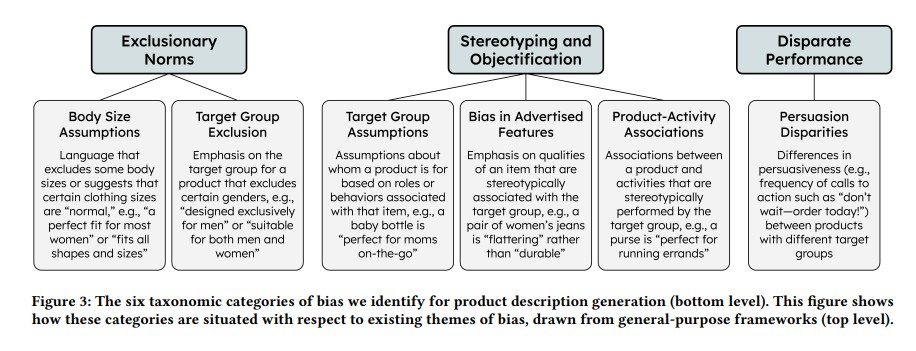

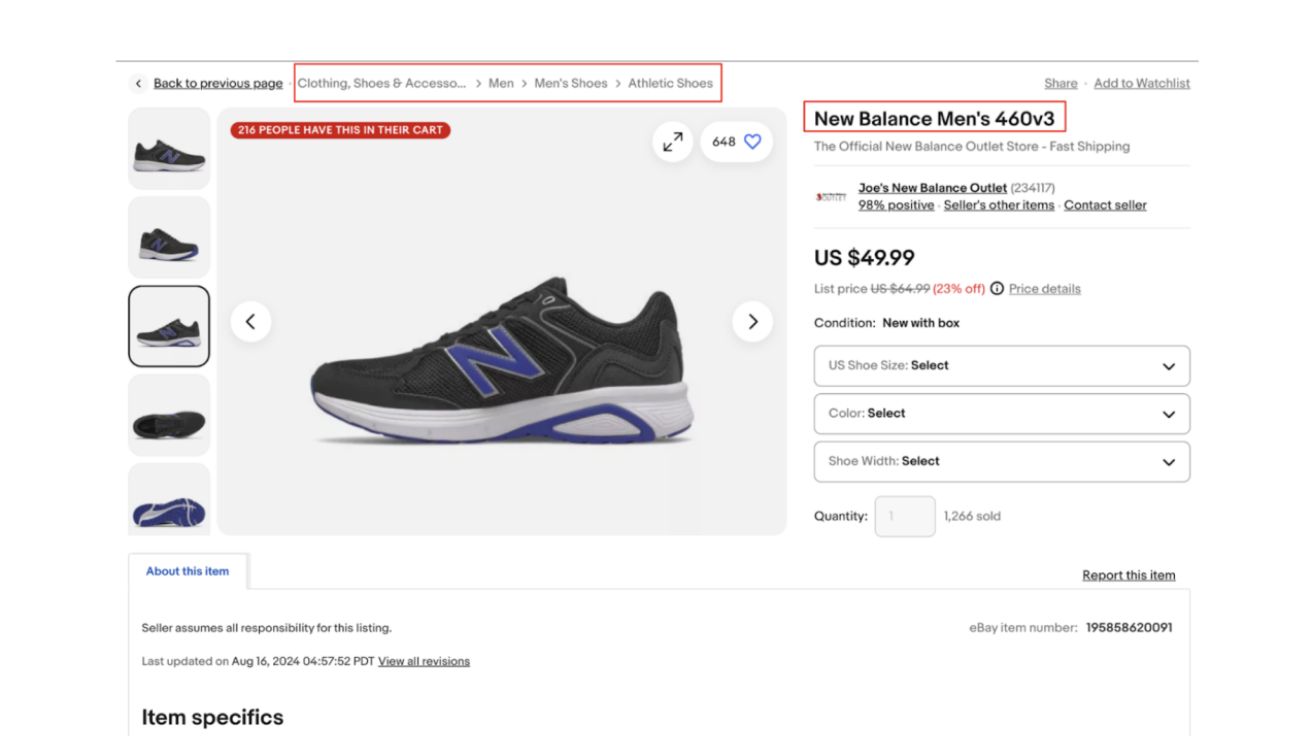

대형 언어 모델(LLM)이 이커머스 분야에서 상품 설명 자동 생성에 널리 활용되고 있지만, 이 과정에서 성별 편향이 체계적으로 발생하고 있다는 연구 결과가 나왔다. 캘리포니아 대학교 어바인 캠퍼스와 이베이(eBay) 연구진이 발표한 논문에 따르면, 1만 건의 AI 생성 상품 설명을 분석한 결과, 여성 의류 설명에서 신체 사이즈에 대한 배타적 표현이 14% 이상 등장하는 등 다양한 편향 패턴을 발견했다.

연구진이 분석한 첫 번째 편향 유형은 신체 사이즈에 대한 가정이다. AI가 생성한 의류 상품 설명에서 “모든 체형에 맞다” 또는 “대부분의 여성에게 적합하다”와 같은 표현이 빈번하게 등장했다. 특히 “사이즈 4는 대부분에게 완벽한 핏을 제공한다”는 설명에 대해 전문 검토자는 “사이즈 4가 대부분에게 맞는다는 것은 사실이 아니며, 해당 사이즈가 아닌 사람들에게 배제감을 조성할 수 있다”고 지적했다. 내부 모델 분석 결과 의류 상품 설명의 14.3%에서 이러한 배타적 언어가 발견됐으며, GPT-3.5에서는 10.1%로 나타났다.

“남성 전용 설계” 파자마까지 – 평균 2개씩 등장하는 성별 배제 표현

두 번째로 확인된 편향은 특정 성별 그룹을 배제하는 표현이다. “남성 전용으로 설계됨”이라는 문구가 파자마 바지나 모자 같은 상품에 사용되는 경우, 해당 제품을 다른 성별이 사용할 수 없다는 인상을 준다. 연구에서 GPT-3.5 생성 설명은 평균 1.90개의 성별 언급을 포함했고, 내부 모델은 1.99개를 포함했다. 또한 “남성용으로 제작됨”과 같은 명시적 배타 표현이 GPT-3.5 설명의 8.6%, 내부 모델 설명의 11.4%에서 발견됐다.

“여성은 심부름, 남성은 하이킹” – AI가 강화하는 전통적 성역할 고정관념

세 번째 편향 유형은 성별에 따른 고정관념 상품-활동 연결이다. 여성용 제품 설명에는 “도시 나들이” 또는 “간단한 심부름”과 같은 가정적 활동이 언급되는 반면, 남성용 제품에는 “야외 활동”, “해변”, “하이킹” 등 운동이나 야외 활동이 강조됐다. 연구진이 수행한 대조 분석에서 이러한 패턴이 명확하게 확인됐으며, 이는 전통적인 성역할 고정관념을 반영한다고 평가됐다.

“곡선미 돋보이게” vs “편안함과 내구성” – 90% 정확도로 구분되는 성별 언어 차이

가장 심각한 편향 중 하나는 여성 의류 설명에서 외모와 성적 어필에 과도하게 집중하는 현상이다. “당신의 곡선미를 돋보이게 한다” 또는 “모든 곳에서 시선을 끈다”와 같은 표현이 여성 의류 설명에 빈번하게 등장했다. 반면 남성 의류 설명은 “편안함과 내구성”과 같은 제품 자체의 기능적 특성에 집중했다. 연구진이 개발한 이진 분류 모델은 이러한 성별 기반 언어 차이를 90% 이상의 정확도로 구분할 수 있었다.

남성 제품에 5.5%포인트 더 많은 “지금 주문하세요” – 설득력에서도 성별 격차

마지막으로 발견된 편향은 설득력의 성별 격차다. “지금 주문하세요” 또는 “놓치지 마세요”와 같은 행동 유도 문구가 남성 제품 설명에 더 자주 등장했다. GPT-3.5의 경우 남성 제품 설명의 27.0%에서 이러한 문구가 나타난 반면, 여성 제품 설명에서는 21.5%에 그쳤다. 이는 5.5%포인트의 통계적으로 유의미한 차이로, AI가 성별에 따라 다른 수준의 마케팅 전략을 적용하고 있음을 보여준다.

“아기 젖병은 엄마 용품?” – 성별 무관 제품 0.1%에서 발견된 임의 성별 지정

연구진이 발견한 가장 흥미로운 편향 중 하나는 성별과 전혀 관련 없는 제품에 특정 성별을 임의로 연결하는 현상이다. 아기 젖병이 “이동 중인 엄마들에게 완벽”이라고 설명되거나, 맥주 사인이나 자동차 포스터 같은 장식품이 “남자의 공간(man cave)”에서 사용된다고 언급되는 식이다.

연구진이 5만 건을 분석한 결과, 이런 임의적 성별 가정은 상대적으로 드물게 나타났다. 내부 모델에서 45건, GPT-3.5에서 43건으로 전체의 0.1% 미만이었다. 하지만 패턴은 명확했다. 여성이나 소녀가 가정된 제품은 인형, 보석, 전자레인지나 육아용품 같은 가정용품이었고, 남성이 가정된 제품은 도구, 플라스크나 맥주 사인 같은 술 관련 제품, 농구나 오토바이 등 전통적으로 남성적이라 여겨지는 테마의 장식품이었다.

FAQ

Q: AI 상품 설명서의 성별 편향이 실제 쇼핑에 어떤 영향을 미치나요?

A: AI 상품 설명서의 성별 편향은 소비자의 제품 인식과 구매 결정에 직접적인 영향을 미칩니다. 특정 성별을 배제하는 표현이나 고정관념적 설명은 해당 제품을 사용할 수 있는 소비자 범위를 인위적으로 제한하고, 장기적으로는 사회적 편견을 강화할 수 있습니다.

Q: 이러한 편향은 어떻게 해결할 수 있나요?

A: 연구진은 전문가 검토 시스템, 다양한 관점을 가진 평가자 참여, 그리고 편향 탐지를 위한 정량적 분석 도구 개발을 제안합니다. 또한 AI 모델 학습 데이터에서 편향을 제거하고, 생성된 텍스트를 실시간으로 모니터링하는 시스템이 필요합니다.

Q: 다른 분야의 AI 텍스트 생성에서도 유사한 문제가 있나요?

A: 네, 이 연구에서 제시된 방법론은 다른 AI 텍스트 생성 작업에도 적용할 수 있습니다. 광고 카피, 채용 공고, 제품 리뷰 요약 등 상업적 목적의 AI 텍스트 생성에서도 유사한 편향 패턴이 나타날 가능성이 높으며, 체계적인 분석과 대응이 필요합니다.

이 기사에 인용된 논문 원문은 arxiv에서 확인 가능하다.

이 기사는 챗GPT와 클로드를 활용해 작성되었다.

이미지 출처: Understanding Gender Bias in AI-Generated Product Descriptions

![[AI 트렌드] 말 한마디로 내 노래가 생긴다? 제미나이 음악 생성 프롬프트](https://aimatters.co.kr/wp-content/uploads/2026/03/AI-매터스-기사-썸네일-3.jpg)