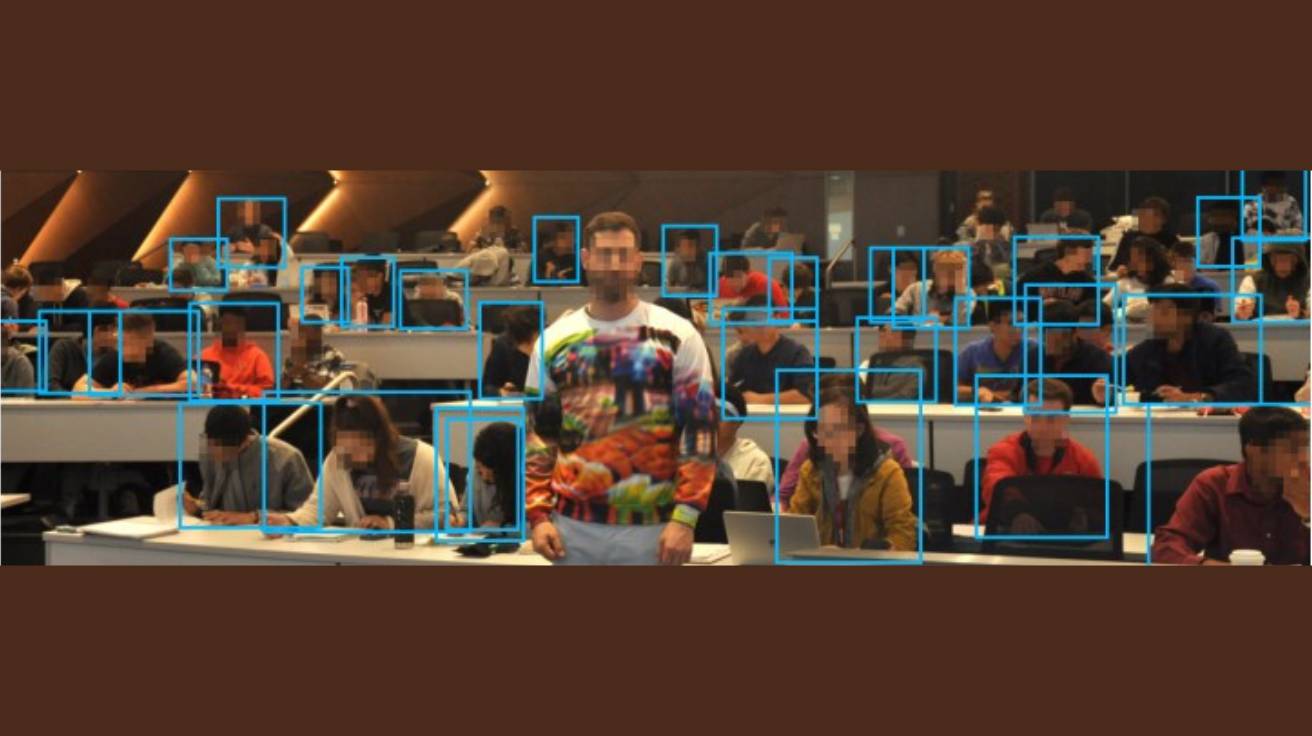

메릴랜드 대학교(University of Maryland)의 주쉬안 우(Zuxuan Wu), 래리 데이비스(Larry S. Davis), 톰 골드스타인(Tom Goldstein) 교수 연구팀과 페이스북 AI(Facebook AI)의 서남 림(Ser-Nam Lim) 연구원이 AI 카메라의 사람 인식 기능을 무력화할 수 있는 특수 패턴을 개발했다. 이 패턴을 인쇄한 포스터나 옷을 착용하면 AI가 사람을 제대로 인식하지 못한다. 연구팀은 컴퓨터 시뮬레이션뿐 아니라 실제 환경에서도 이 기술이 작동함을 확인했다.

“AI 카메라가 사람을 못 본다”…특수 패턴 옷 입으면 탐지 회피 가능

메릴랜드 대학교(University of Maryland)의 주쉬안 우(Zuxuan Wu), 래리 데이비스(Larry S. Davis), 톰 골드스타인(Tom Goldstein) 교수 연구팀과 페이스북 AI(Facebook AI)의 서남 림(Ser-Nam Lim) 연구원이 AI 카메라의 사람 인식 기능을 무력화할 수 있는 특수 패턴을 개발했다. 이 패턴을 인쇄한 포스터나 옷을 착용하면 AI가 사람을 제대로 인식하지 못한다. 연구팀은 컴퓨터 시뮬레이션뿐 아니라 실제 환경에서도 이 기술이 작동함을 확인했다.

컴퓨터 시뮬레이션에서 AI 인식률 90% 이상 감소

연구팀은 AI가 사람을 인식하지 못하도록 만드는 특수 패턴을 개발했다. 이 패턴을 만들기 위해 12만 3천 장의 사진이 담긴 COCO 데이터셋에서 사람이 포함된 1만 장을 선별해 학습에 사용했다. 연구팀은 YOLOv2, YOLOv3, Faster RCNN 등 산업계에서 널리 쓰이는 AI 인식 시스템들을 대상으로 실험했다. 컴퓨터 시뮬레이션 결과가 놀라웠다. YOLOv2용 패턴을 YOLOv2 시스템에 적용하자 인식 정확도가 정상일 때 62.7%에서 7.5%로 급락했다. 모든 패턴이 최소 29% 이상 인식 성능을 떨어뜨렸다. 이는 AI 시스템이 사람을 거의 찾아내지 못한다는 의미다.

더 흥미로운 점은 한 AI 시스템을 속이기 위해 만든 패턴이 다른 AI 시스템도 속일 수 있다는 사실이다. 예를 들어 YOLOv2용 패턴은 Faster RCNN 계열 시스템들도 효과적으로 속였다. R50-FPN 시스템의 인식률은 82.1%에서 21.4%로, R50-C4는 78.7%에서 19.0%로 떨어졌다. 다만 반대의 경우, 즉 Faster RCNN용 패턴으로 YOLO 시스템을 속이는 것은 상대적으로 어려웠다.

연구팀은 ResNet-101, ResNeXt-101, Mask RCNN, RetinaNet, FCOS 등 다양한 구조의 AI 시스템에서도 이 패턴이 작동함을 확인했다. 특히 사람 인식용 패턴이 자전거, 새, 배, 버스, 고양이 등 다른 사물의 인식도 방해할 수 있다는 점도 발견했다. 이는 사람이 대부분의 장면에서 다른 사물들과 함께 나타나기 때문으로 보인다.

실제 인쇄한 포스터로도 AI 속이기 성공

연구팀은 컴퓨터 화면이 아닌 실제 세상에서도 이 방법이 통하는지 확인하기 위해 대형 포스터 실험을 진행했다. 15곳의 다양한 장소에서 10종류의 패턴을 대형으로 인쇄한 포스터를 들고 630장의 사진을 촬영했다. 각 장소에서 카메라와의 거리를 바꿔가며, 포스터를 드는 높이도 달리하며 실험했다. 실험에 사용한 패턴은 YOLOv2 패턴, 여러 AI 시스템을 동시에 고려한 앙상블 패턴, 미세 조정한 패턴 등이었다. 비교를 위해 프랑스 화가 조르주 쇠라의 그림 일부, 패턴을 거꾸로 뒤집은 것, 흰색 포스터도 함께 테스트했다.

인쇄된 포스터를 사용한 결과, 특수하게 만든 패턴들은 모든 AI 시스템의 인식 성능을 크게 떨어뜨렸다. YOLOv2 패턴이 가장 효과적이었다. AI 시스템 중에서는 R50-FPN이 가장 잘 버텼고, FCOS가 가장 쉽게 속았다. 흥미롭게도 FCOS는 학습에 전혀 사용되지 않았는데도 큰 영향을 받았다.

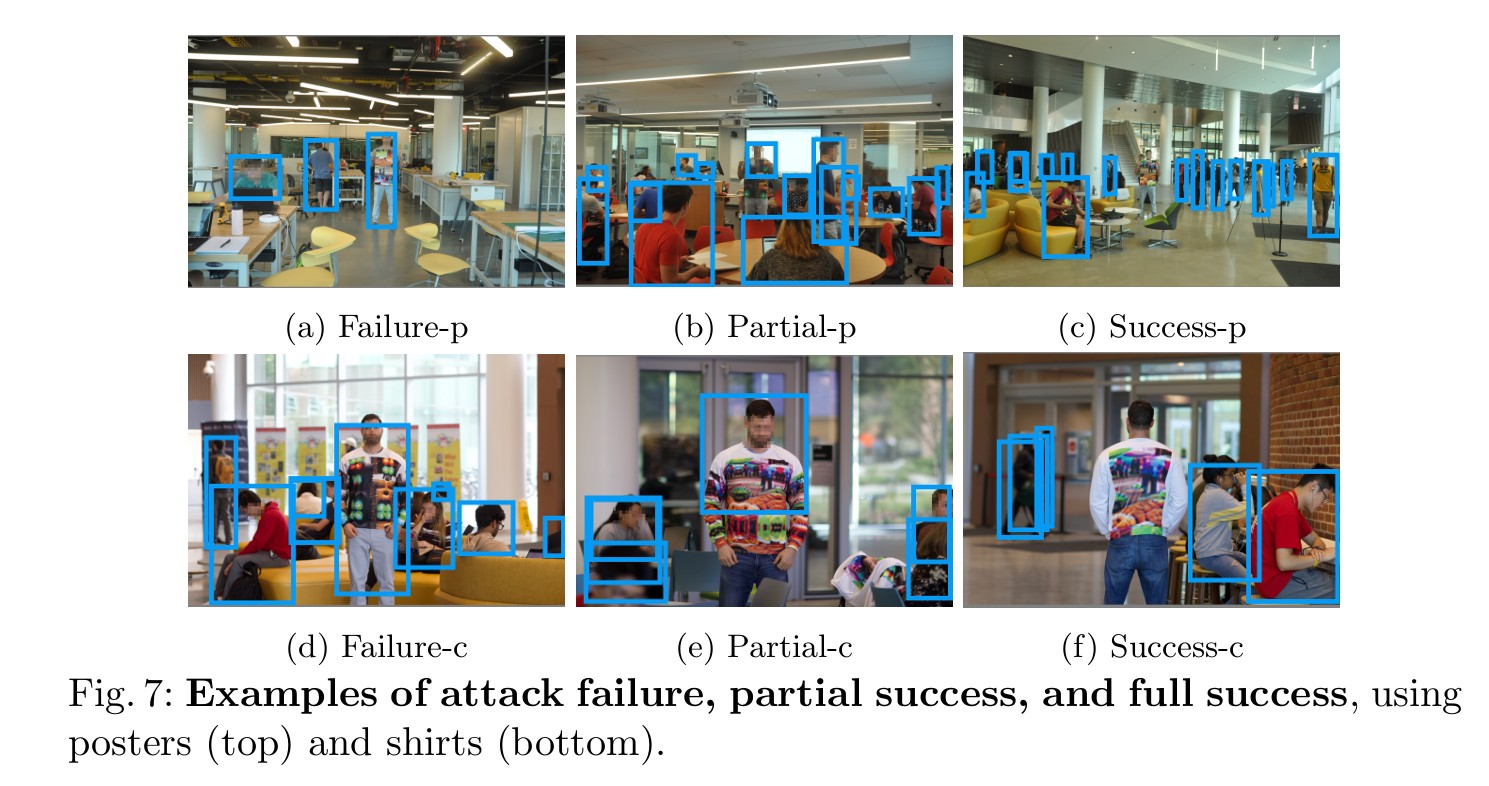

성공 여부를 세 단계로 나눠 평가했다. ‘성공’은 AI가 사람을 전혀 찾지 못한 경우, ‘부분 성공’은 사람의 절반도 안 되는 영역만 인식한 경우, ‘실패’는 사람을 제대로 인식한 경우다. YOLOv2 패턴은 YOLOv2 시스템에 대해 약 70%의 성공 및 부분 성공률을 보였다. 다만 다른 AI 시스템을 속이는 데는 한계가 있었다. 특이한 점은 쇠라의 그림 패턴이 시각적으로는 YOLOv2 패턴과 비슷해 보였지만 AI를 속이는 효과는 거의 없었다는 것이다. 또 패턴을 거꾸로 뒤집자 효과가 크게 떨어졌다. 이는 학습된 패턴이 AI의 일반적인 약점이 아니라 특정한 작동 방식을 공략한다는 것을 보여준다.

티셔츠에 인쇄해 입어도 효과 있어

연구팀은 한 걸음 더 나아가 이 패턴을 티셔츠에 인쇄했다. 포스터는 평평하고 고정되어 있지만, 옷은 몸의 움직임에 따라 구겨지고 변형된다. 이런 복잡한 상황에서도 효과가 있을까? 10곳의 장소에서 8종류의 패턴 티셔츠를 입고 360장의 사진을 촬영했다. YOLOv2 패턴의 크기를 다르게 한 4가지 버전, 복잡한 변형을 고려해 만든 TPS 패턴, 앙상블 패턴 등을 제작했다. 각 장소에서 앞뒤 방향을 바꾸고 카메라와의 거리도 조절하며 촬영했다.

티셔츠를 입은 실험에서도 AI의 인식 성능이 크게 떨어졌다. AI가 사람을 찾아내더라도 여러 개의 작은 조각으로 쪼개져 인식되는 경우가 많았다. 포스터 실험에서 약했던 FCOS 시스템은 티셔츠 실험에서는 상대적으로 잘 버텼다. 이는 티셔츠가 AI 학습 데이터에 포함된 일반적인 옷과 비슷하기 때문으로 추정된다.

YOLOv2 패턴 티셔츠는 YOLOv2 시스템에 대해 약 50%의 성공률을 기록했다. 하지만 다른 AI 시스템을 속이는 것은 여전히 어려웠다. 패턴 크기가 작을수록 효과가 떨어졌고, 패턴을 반복해서 티셔츠 전체를 덮어도 성능에는 큰 문제가 없었다. 복잡한 변형을 고려해 만든 TPS 패턴은 예상과 달리 효과가 떨어졌는데, 학습 과정이 너무 복잡해진 것이 원인으로 보인다.

종이 인형 실험으로 밝혀낸 성능 저하 원인

연구팀은 컴퓨터에서 잘 작동하던 패턴이 실제 세상에서 효과가 줄어드는 이유를 찾기 위해 ‘종이 인형’ 실험을 했다. 사진을 인쇄한 뒤 그 위에 패턴을 인쇄한 종이를 올려놓고 다시 촬영하는 방식이다. COCO 데이터셋에서 20개 이미지를 선정해 테스트했다. 일부러 구겨진 패턴도 만들어 실제 옷처럼 변형되는 상황을 재현했다.

종이 인형은 대형 포스터보다는 약간 나은 성능을 보였지만, 컴퓨터 시뮬레이션에 비하면 여전히 효과가 떨어졌다. 종이 인쇄 품질이 매우 좋았는데도 성능 차이가 발생했다는 점이 중요하다. 이는 카메라의 이미지 처리 과정, 픽셀화, 압축 알고리즘 등이 주요 원인임을 보여준다. 조명 변화, 촬영 각도, 물리적 변형도 영향을 준다.

2019년 논문, 왜 지금 다시 주목받나

이 연구가 6년이 지난 시점에 다시 주목받는 이유는 AI 감시 기술의 일상화와 관련이 깊다. 현재 CCTV, 스마트폰 카메라, 자율주행차 등에 탑재된 AI 인식 시스템이 편의성을 제공하는 동시에 프라이버시 침해 우려도 커지고 있다. SNS에서는 곧 AI의 감시에서 벗어날 수 있는 종류의 발명품이나 제품이 각광을 받을 지 모른다며 해당 논문을 주목하고 있다. 이 논문은 첨단 AI 시스템도 특정 패턴에 취약할 수 있다는 점을 보여주며, AI 보안의 허점과 감시 기술의 한계에 대한 논의를 촉발한 바 있다.

다만 연구팀이 실험한 2019년 당시의 AI 모델들과 현재의 최신 모델들 사이에는 상당한 기술 격차가 있다. 이후 AI 인식 시스템은 지속적으로 발전해왔으며, 이러한 적대적 공격을 탐지하고 방어하는 연구도 활발히 진행되고 있다.

FAQ (※ 이 FAQ는 본지가 논문을 참고해 자체 작성한 내용입니다.)

Q1. 이 패턴은 어떻게 AI를 속이나요?

A: AI 사람 인식 시스템은 이미지에서 수백에서 수천 개의 후보 영역을 만들고 각각에 점수를 매깁니다. 이 패턴은 모든 후보 영역의 점수를 동시에 낮춰서 AI가 “여기 사람이 있다”고 판단하지 못하게 만듭니다.

Q2. 왜 실제 환경에서는 효과가 줄어드나요?

A: 종이 인형 실험 결과 카메라의 이미지 처리 과정이 주요 원인으로 밝혀졌습니다. 카메라가 자동으로 이미지를 보정하고, 픽셀로 변환하고, 파일 크기를 줄이는 과정에서 패턴의 효과가 약해집니다. 조명이나 촬영 각도 변화도 영향을 줍니다.

Q3. 모든 AI 시스템이 똑같이 속나요?

A: 아닙니다. 실험 결과 R50-FPN이 가장 잘 버텼고, FCOS가 인쇄 포스터에 가장 쉽게 속았습니다. 하지만 FCOS는 티셔츠 실험에서는 상대적으로 강했습니다. YOLOv2 패턴은 Faster RCNN 계열 시스템도 잘 속였지만, 반대는 효과가 제한적이었습니다.

해당 기사에 인용된 논문 원문은 arvix에서 확인 가능하다.

논문명: Making an Invisibility Cloak: Real World Adversarial Attacks on Object Detectors

이미지 출처: Making an Invisibility Cloak: Real World Adversarial Attacks on Object Detectors

해당 기사는 챗GPT와 클로드를 활용해 작성되었습니다.