Making AI Less “Thirsty”: Uncovering and Addressing the Secret Water Footprint of AI Models

AI의 물 발자국 심각성: 2027년 AI 산업, 덴마크 6개국 연간 물 사용량 초과 예상

생성형 인공지능(AI)의 탄소 배출량에 대한 우려가 증가하고 있지만, 이에 못지않게 중요한 물 소비 문제는 공론화되지 않고 있다. 마이크로소프트의 최첨단 미국 데이터센터에서 GPT-3 언어 모델을 훈련시키는 데 약 70만 리터의 깨끗한 담수가 증발하지만, 이러한 정보는 비밀에 부쳐져 왔다. 더 심각한 것은 2027년 전 세계 AI 수요가 42억~66억 입방미터의 물을 취수할 것으로 예상된다는 점이다. 이는 덴마크 4~6개국의 연간 총 물 취수량보다 많거나 영국의 절반에 해당하는 양이다.

담수 부족이 인류가 직면한 가장 시급한 과제 중 하나로 부상하는 가운데, AI 산업은 사회적 책임을 다하고 자체적인 물 발자국 문제를 해결함으로써 솔선수범해야 한다. UC 리버사이드와 UT 알링턴 연구진이 발표한 이 논문에서는 AI의 물 발자국을 추정하는 체계적인 방법론을 제시하고, AI 운영 시 물 효율성의 시공간적 다양성을 논의하며, 진정으로 지속 가능한 AI를 위해 탄소 발자국과 함께 물 발자국을 종합적으로 해결해야 할 필요성을 강조한다.

GPT-3도 물을 마신다, 한 번 훈련에 540만 리터

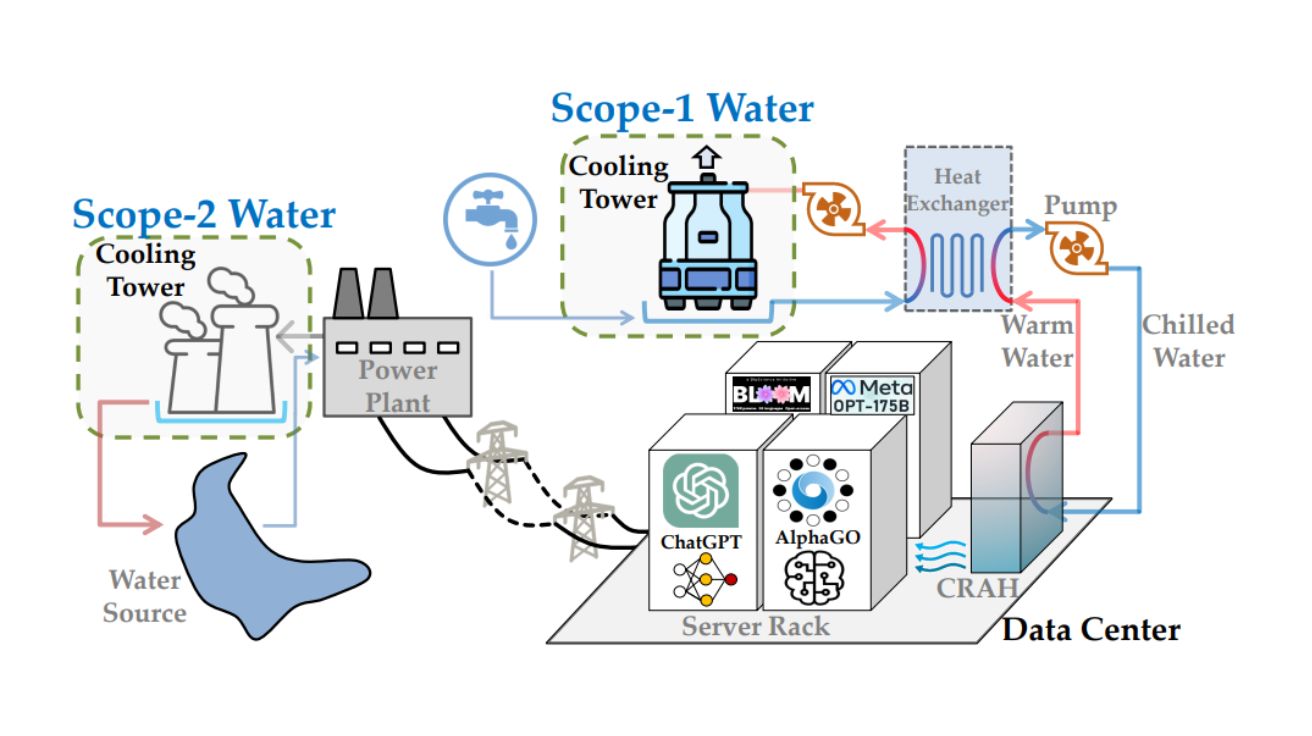

AI 모델이 소비하는 물은 크게 세 가지 범주로 나뉜다. 데이터센터 냉각에 사용되는 현장 물 사용량(스코프 1), 전력 생산에 필요한 오프사이트 물 사용량(스코프 2), 그리고 서버 제조에 사용되는 공급망 물 사용량(스코프 3)이다.

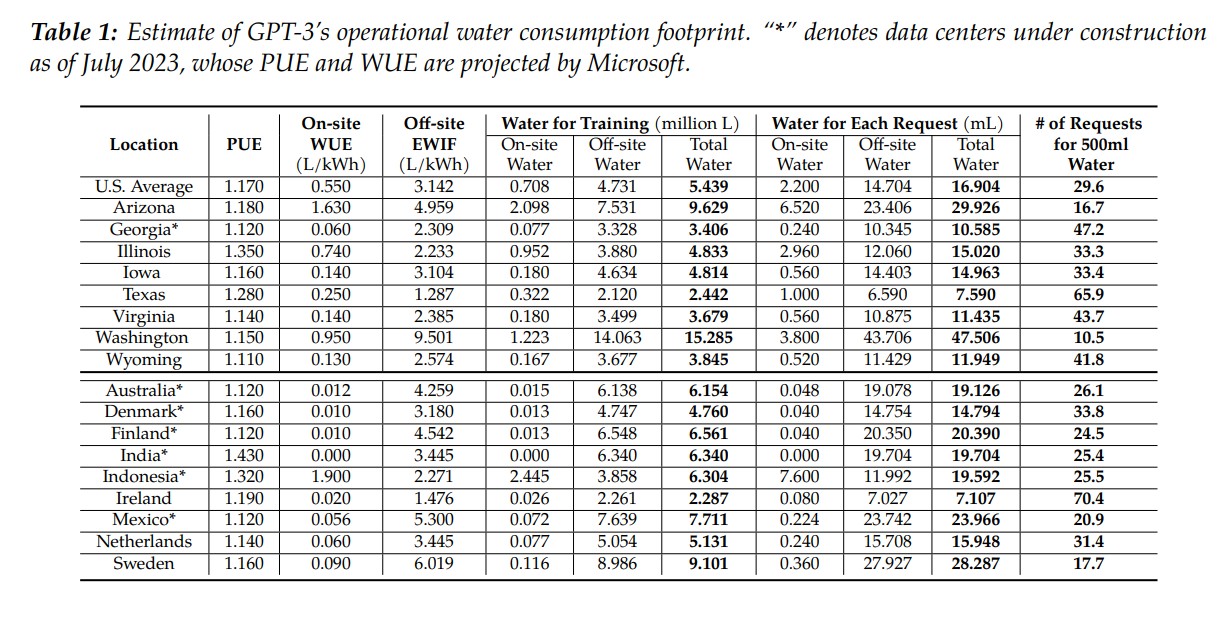

연구팀은 1750억 개의 매개변수를 가진 GPT-3 모델을 사례 연구로 활용하여 운영 물 소비량을 추정했다. 마이크로소프트의 미국 데이터센터에서 GPT-3를 훈련시키면 총 540만 리터의 물이 소비되며, 이 중 70만 리터는 스코프 1 현장 물 소비에 해당한다. 또한 GPT-3는 중간 길이의 응답 10~50개를 생성하는 데 500ml 물병 하나를 ‘마신다’. 이는 배치된 시간과 장소에 따라 달라진다.

특히 아리조나와 같은 더운 지역에서 AI 모델을 훈련시키면 물 소비량이 급증한다. 아리조나에서 GPT-3를 훈련시키면 총 963만 리터의 물이 소비되며, 워싱턴에서는 1529만 리터로 더 많은 물이 소비된다. 반면, 텍사스는 244만 리터로 가장 적은 물을 소비한다. 이는 AI 모델을 훈련시키는 ‘시기’와 ‘장소’가 물 발자국에 큰 영향을 미친다는 것을 보여준다.

AI의 물 발자국, 언제 어디서 훈련하느냐가 중요하다

AI의 물 효율성(WUE, Water Usage Effectiveness)은 공간적, 시간적으로 다양하게 변한다. 외부 기온이 올라가면 냉각탑의 현장 WUE가 크게 증가하고, 외부 공기가 너무 뜨겁거나 습도가 너무 낮을 때는 외부 공기 냉각의 WUE도 증가한다. 오프사이트 WUE는 전력 생산에 사용되는 연료 구성에 따라 시간과 지역에 따라 달라진다.

연구진은 AI 모델의 운영 물 발자국을 다음과 같이 계산했다. 물 발자국 = 에너지 사용량 × [현장 WUE + (PUE × 오프사이트 WUE)] 이 공식을 통해 AI 모델의 훈련 일정을 물 소비량이 적은 시간대(예: 자정)로 조정하거나, 물 효율성이 더 좋은 데이터센터에서 실행함으로써 물 발자국을 크게 줄일 수 있다. 물 의식이 있는 사용자들이 물 효율적인 시간대나 데이터센터에서 AI 추론을 선호한다면, 수요 측 유연성을 통해 AI의 물 발자국을 줄일 수 있다.

탄소와 물 사이의 균형, ‘태양을 따르다’ VS ‘태양을 피하다’

탄소 발자국을 줄이기 위해서는 태양 에너지가 풍부할 때 “태양을 따르는” 것이 바람직하지만, 물 발자국을 줄이기 위해서는 WUE가 높은 하루 중 고온 시간대를 피하는 “태양을 피하는” 전략이 더 효과적일 수 있다. 이는 스코프 2 물 소비 강도 요소와 탄소 배출률 사이의 불일치에서도 확인할 수 있다. 한 발자국을 최소화하면 다른 발자국이 증가할 수 있기 때문이다. 이러한 관찰은 탄소와 물 발자국의 환경적 영향이 대체 가능하지 않다는 이전 연구 결과를 더욱 뒷받침한다. 따라서 탄소 효율과 물 소비 균형을 이루기 위해서는 탄소 효율적이면서도 물 사용량이 적은 종합적인 접근 방식이 필요하다.

AI 물 발자국의 투명성 부재: 모델 카드에 탄소는 있고 물은 없다

AI의 물 발자국은 상대적으로 적은 관심을 받아왔다. AI 모델 카드에는 일상적으로 탄소 배출량이 포함되지만, 현장 직접 물 사용량(취수 또는 소비)은 누락되어 있다. 이러한 투명성 부족은 물 지속가능성을 위한 혁신 노력을 방해할 수 있다. 데이터센터는 현장 물 소비를 최소화하기 위해 기후 친화적인 냉각 시스템 설계를 채택하고 있지만, 이러한 노력은 주로 스코프 1 물 사용에 초점을 맞추고 스코프 2 영향은 대체로 간과하고 있다. 기후 변화 완화를 위해 스코프 2 탄소 배출을 해결하는 것이 중요한 것처럼, 최근 미국 데이터센터 에너지 보고서에서 언급한 바와 같이 AI의 “진정한 물 비용”을 줄이기 위해 스코프 2 물 소비를 해결하는 것도 똑같이 중요하다.

메타와 같은 일부 기술 기업들은 지속가능성 보고서에 스코프 2 물 소비를 포함하기 시작했다. 연구진은 스코프 2 물 소비 보고를 표준 관행으로 권장한다. 이 접근법은 오프사이트 물 소비를 AI 모델 개발자와 최종 사용자에게 가시화하고, 수요 측 유연성에 대한 새로운 기회를 열어 전체적인 물 자원 부담을 완화할 수 있다.

FAQ

Q: AI 모델이 물을 소비한다는 것은 무슨 의미인가요?

A: AI 모델 자체가 직접 물을 마시는 것은 아닙니다. AI 모델을 훈련하고 운영하는 데이터센터가 서버 냉각을 위해 물을 사용하고, 전력 생산 과정에서도 물이 사용됩니다. 특히 냉각탑에서는 열을 식히기 위해 물을 증발시키고, 전력 발전소에서도 전기 생산을 위해 물을 사용합니다. 이 모든 물 사용량을 합쳐서 AI의 ‘물 발자국’이라고 합니다.

Q: GPT-3 같은 대형 AI 모델이 사용하는 물의 양은 얼마나 되나요?

A: 마이크로소프트의 미국 데이터센터에서 GPT-3를 훈련시키면 약 540만 리터의 물이 소비됩니다. 이는 올림픽 수영장 2개를 채우는 양입니다. 또한 GPT-3가 중간 길이의 응답 10~50개를 생성하는 데 500ml 물병 하나가 필요합니다. 위치와 시간에 따라 물 소비량은 크게 달라질 수 있습니다.

Q: AI의 물 소비를 줄이기 위해 무엇을 할 수 있나요?

A: AI의 물 소비를 줄이기 위한 방법으로는 물 효율성이 높은 지역과 시간대에 AI 모델을 훈련하고 운영하는 것, 물 사용량이 적은 냉각 시스템을 도입하는 것, 그리고, AI 모델 카드에 물 소비량을 투명하게 공개하여 인식을 높이는 것 등이 있습니다. 또한 소비자로서는 물 효율성이 높은 시간대에 AI 서비스를 이용하는 것이 도움이 될 수 있습니다.

해당 기사에서 인용한 논문 원문은 링크에서 확인할 수 있다.

이미지 출처: 이디오그램 생성

기사는 클로드와 챗GPT를 활용해 작성되었습니다.