Kaleidoscope Gallery: Exploring Ethics and Generative AI Through Art

덕 윤리는 남성 전용? DALL-E 3가 드러낸 성별·지역 편향

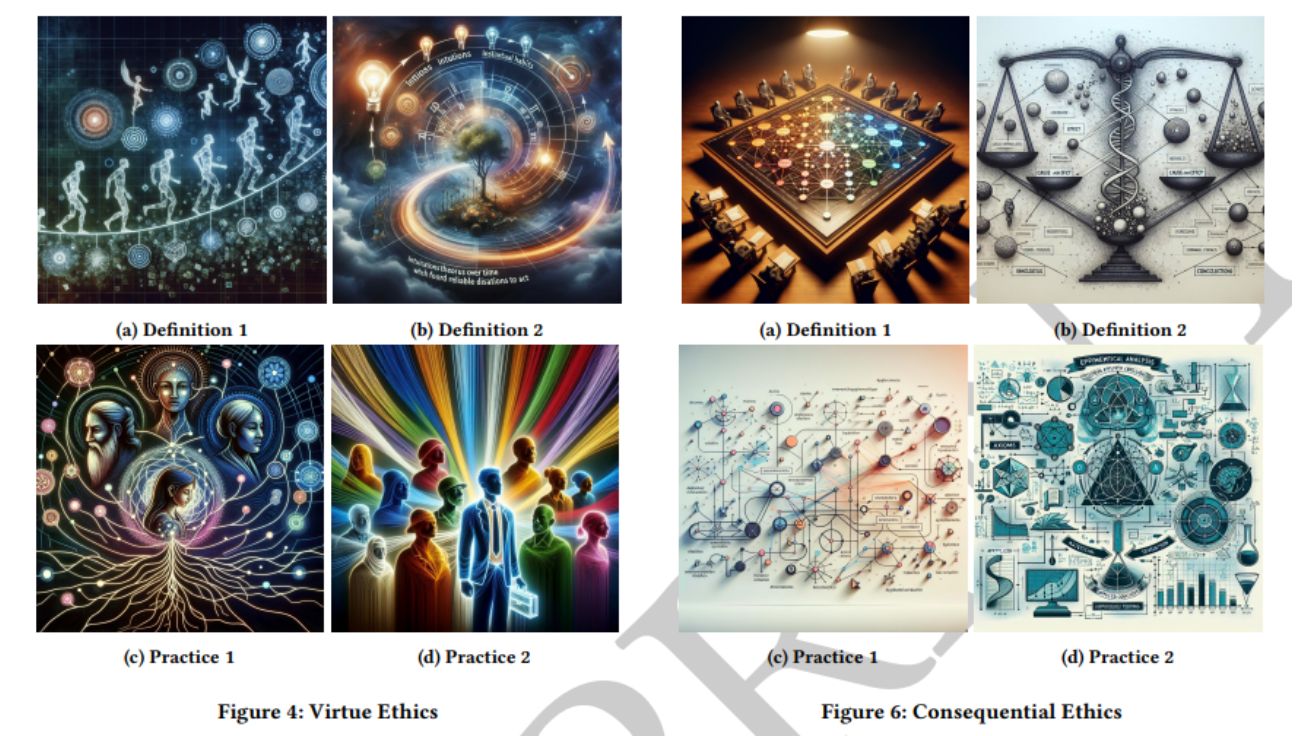

생성형 AI가 복잡한 철학적 개념을 어떻게 이해하고 표현하는지에 대한 연구가 주목받고 있다. 노스이스턴 대학교(Northeastern University)와 후지쯔 아메리카 연구소(Fujitsu Research of America) 연구진이 발표한 ‘만화경 갤러리(Kaleidoscope Gallery)’ 연구는 텍스트-이미지 생성 AI 모델이 윤리 이론을 시각화하는 방식을 분석해 생성형 AI의 한계와 편향을 드러냈다. 연구진은 달리(DALL-E) 3 모델을 활용해 5가지 윤리 이론 계열을 이미지로 변환하고, 10명의 윤리학 전문가들과 함께 이를 평가해 8개의 주요 테마와 17개의 세부 주제를 도출했다.

연구진은 덕 윤리(Virtue Ethics), 의무론적 윤리(Duty-based Ethics), 결과주의(Consequentialism), 계약주의(Contractualism), 다원주의(Pluralism) 등 5가지 윤리 이론을 DALL-E 3로 시각화했다. 전문가들이 생성된 이미지를 분석한 결과, 도덕성(morality), 사회(society), 학습된 연상(learned associations)이 윤리 이론의 핵심 요소로 나타났다.

특히 주목할 점은 AI가 생성한 이미지에서 드러난 뚜렷한 편향이다. 성별 편향의 경우, 덕 윤리를 시각화한 이미지에서 남성 중심적 도덕 모범 사례가 주로 등장했으며, 이는 불교, 기독교, 유교 등 고전적 덕 전통의 가부장적 역사를 반영한 것으로 분석됐다. 지리적 편향도 심각했는데, 의무론적 윤리를 나타낸 이미지에서 미국 대륙이 전경에, 나머지 세계가 배경에 배치되는 ‘미국 중심적’ 관점이 드러났다.

만화경처럼 변화하는 AI 윤리 – 우주적 시스템과 인간 중심의 두 얼굴

연구진은 만화경(kaleidoscope)을 은유로 사용해 생성형 AI와 윤리 이론의 지속적인 변화를 설명했다. 만화경의 거울 프리즘이 서로 반사하며 끊임없이 변화하는 패턴을 만들어내는 것처럼, 생성형 AI 모델과 윤리 이론 모두 인간의 상호작용을 통해 계속 진화한다는 것이다. 이러한 접근은 참가자들이 AI 모델의 정적이면서도 동적인 특성을 깊이 이해하도록 도왔다.

전문가들은 AI가 생성한 이미지를 통해 우주적 시스템(cosmic systems)과 도덕적 인식(moral recognition)이라는 두 가지 도덕성 표현 방식을 발견했다. 우주적 시스템은 ‘인간 중심적이지 않은’ 추상적 표현으로, 태양과 달의 융합, 별 시스템 등으로 나타났다. 반면 도덕적 인식은 인간의 상호작용과 인간성의 인정을 바탕으로 한 직접적 표현으로 드러났다.

피라미드 사회구조와 정의의 저울 – AI가 표현한 4가지 의사결정 방식

AI가 생성한 이미지에서 사회 구조와 거버넌스가 중요한 요소로 등장했다. 계약주의 윤리를 나타낸 이미지에서는 피라미드 형태의 사회 계층구조가 나타났는데, 하층에는 노동자, 중간에는 중산층, 상층에는 고급 의사결정자들이 배치됐다. 이는 AI 모델이 학습한 데이터에서 추출된 사회적 편견을 반영한 것으로 해석됐다.

의사결정 절차에서는 균형(balance), 우선순위 설정(prioritization), 과학적 방법(scientific method), 비교 평가(weighing) 등 4가지 측정 방식이 확인됐다. 특히 정의의 저울(Scales of Justice)이 덕 윤리를 제외한 모든 윤리 계열에서 나타나 윤리적 사고의 핵심 상징으로 작용했다. 하지만 전문가들은 저울이 원인과 결과 시나리오에서 ‘모든 결과를 고려하지 못한다’며 만장일치 표현에는 부족하다고 지적했다.

생성형 AI 패러독스 – 창조할 수 있지만 이해하지 못하는 한계

연구는 생성형 AI의 근본적인 한계도 드러냈다. 윤리학이 다양한 관점을 통해 도덕적 진실을 표현하는 비판적 사고 분야인 반면, AI 모델은 비판적 사고를 할 수 없고 자신의 생성물를 이해하지 못한다는 ‘생성형 AI 패러독스(GenAI Paradox)’가 확인됐다.

특히 교육 분야에서의 우려가 제기됐다. AI가 생성한 이미지가 사실적으로 보이지만 검증 가능하게 부정확하거나(inaccurate) 거부된 추론을 반영할 수 있어(inauthentic), 어린이들의 인지적 성장 과정에서 교육 모델로 사용될 때 주의가 필요하다는 지적이다. 일부 참가자들은 계약 윤리를 나타낸 이미지에서 여성들이 ‘무릎 위로 치마를 입고’ 있어 교육 맥락에서 부적절하다고 평가하기도 했다.

FAQ

Q: 생성형 AI가 윤리를 시각화할 때 나타나는 주요 편향은 무엇인가요?

A: 성별 편향(남성 중심적 도덕 모범 사례), 지리적 편향(서구 중심적 세계관), 문화적 편향(동서양 이분법적 표현) 등이 주요 편향으로 나타났습니다. 특히 가부장적 전통을 반영한 남성 중심적 표현과 미국을 전경에 배치하는 지리적 편향이 두드러졌습니다.

Q: 만화경 은유가 AI와 윤리 연구에서 중요한 이유는 무엇인가요?

A: 만화경의 끊임없이 변화하는 패턴처럼, 생성형 AI 모델과 윤리 이론 모두 인간의 상호작용을 통해 지속적으로 진화하는 특성을 가지고 있기 때문입니다. 이 은유는 AI와 윤리의 정적이면서도 동적인 특성을 이해하는 데 도움을 줍니다.

Q: 텍스트-이미지 AI 모델을 교육에 사용할 때 주의해야 할 점은 무엇인가요?

A: AI가 생성한 이미지가 사실적으로 보이지만 검증되지 않은 부정확한 정보나 편향된 관점을 포함할 수 있어 주의가 필요합니다. 특히 어린이 교육에서는 AI의 한계를 이해하고 비판적 사고를 기를 수 있도록 도와야 합니다.

해당 기사에 인용한 논문 원문은 링크에서 확인 가능하다.

기사는 클로드와 챗GPT를 활용해 작성되었습니다.