비전언어모델

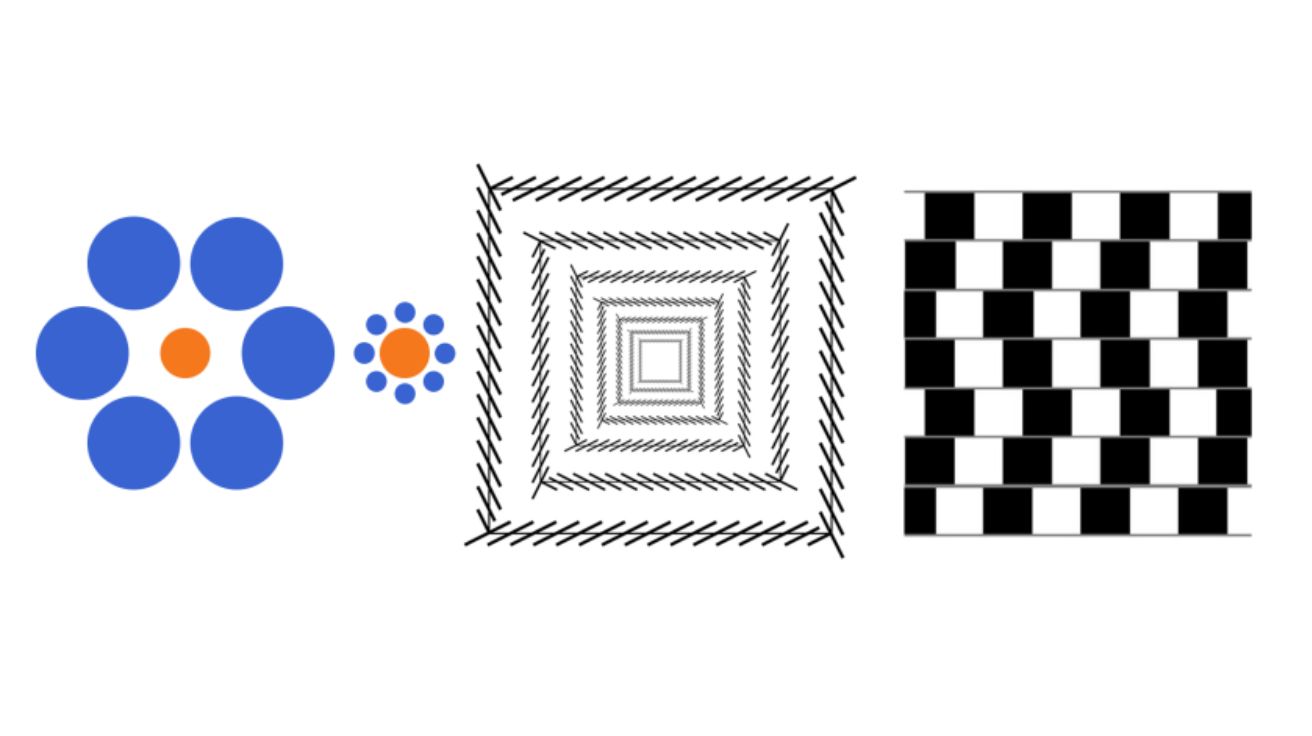

AI도 착시 효과에 속을까 실험해봤더니… 특정 착시에는 사람처럼 반응해

인공지능(AI)이 사람과 얼마나 다르게 사물을 보는지에 대한 흥미로운 연구가 나왔다. 양지안이(Jianyi Yang)와 예준이(Junyi Ye), 대시 안칸(Ankan Dash), 왕굴링(Guiling Wang) 연구원이 공개한 논문에 따르면, 해당…

‘인간처럼 생각하는 로봇 만든다’… 엔비디아, 비전 언어 모델 ‘코스모스 리즌’ 오픈소스로 공개

엔비디아가 로봇과 물리적 AI를 위한 새로운 비전 언어 모델 ‘코스모스 리즌(NVIDIA Cosmos Reason)’을 공개했다고 11일(현지 시간) 발표했다. 엔비디아 기술 블로그에 따르면, 올해 GTC 2025에서…

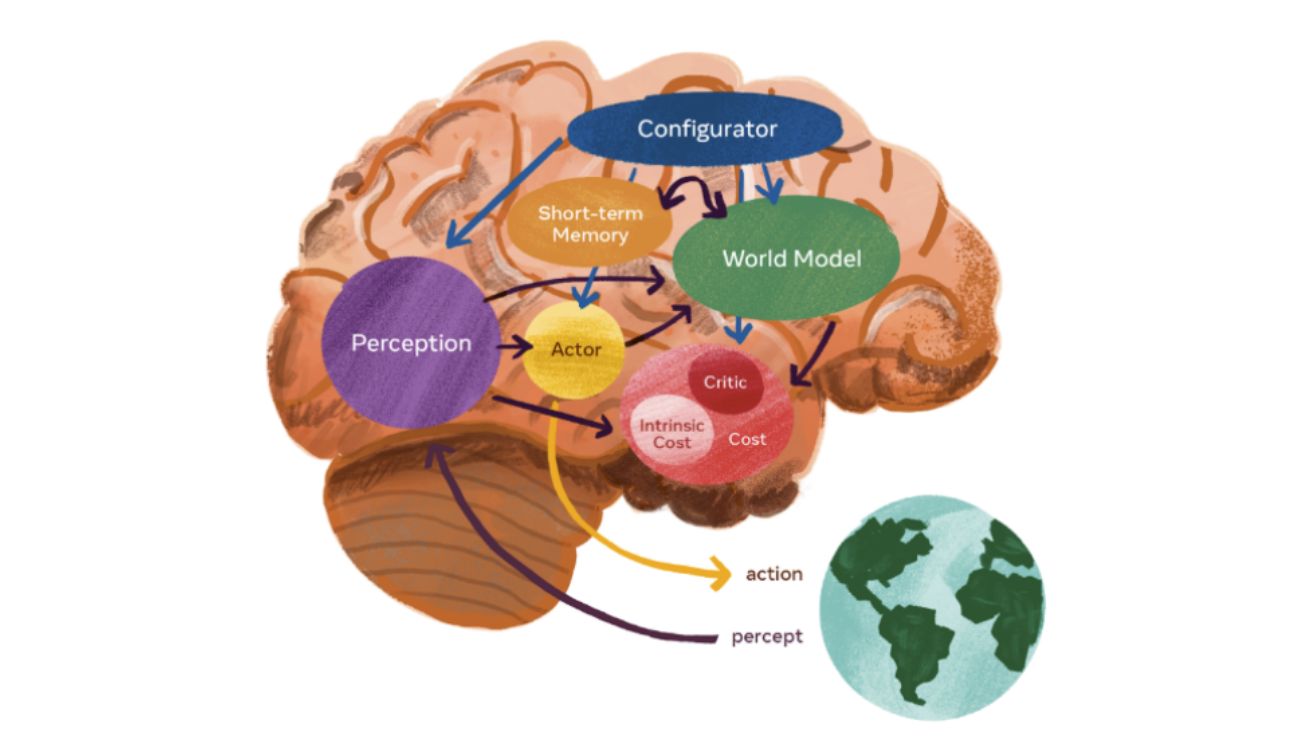

메타 AI, 인간처럼 보고 듣는 AI 로봇 공개… 구체화 AI 에이전트 시대 개막

Embodied AI Agents: Modeling the World 메타 AI 연구소가 차세대 인공지능 기술 발전을 위해 수행한 대규모 연구 프로젝트에서, 물리적 환경과 직접 상호작용할 수 있는…

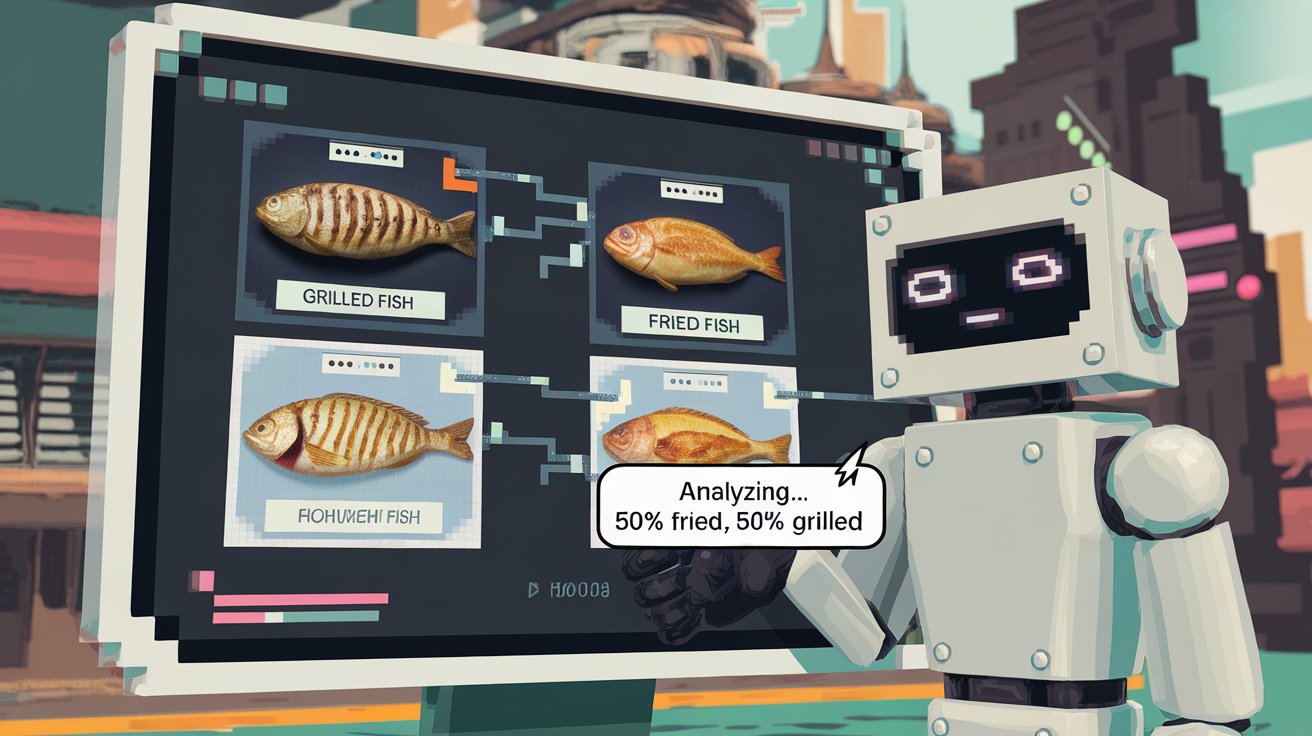

AI는 튀김과 구이를 구별할 수 있을까? AI 모델들의 식품 인식 기술 검증 결과

Are Vision-Language Models Ready for Dietary Assessment? 비공개 소스 AI 모델, 식품 인식에서 90% 이상의 정확도 달성 인공지능(AI) 발전으로 식품 이미지 인식 기술이 크게…

큐웬, AI 비전-언어 모델 ‘Qwen2.5-VL-32B’ 출시… “주관적 경험과 수학적 추론에 최적화”

알리바바의 Qwen 팀은 24일(현지 시간) 자사 블로그를 통해 새로운 시각-언어 모델인 Qwen2.5-VL-32B-Instruct를 오픈소스로 공개했다. 이 모델은 기존 Qwen2.5-VL 시리즈의 최적화 버전으로, 인간 선호도에 더…

과기정통부, 공공 분야 AI 확산 가속화… 2025년 신규 과제 10개 선정

과학기술정보통신부(장관 유상임, 이하 ‘과기정통부’)가 공공 분야에 인공지능(AI) 기술을 확산하기 위한 신규 사업을 본격 추진한다. 과기정통부는 18일(한국 시간), 10개 부처 및 기관과 협업해 ‘부처협업 기반…

웹 데이터로 학습한 로봇 RT-2, ‘안경 쓴 사람에게 음료 전달’ 같은 복잡한 지시도 수행

RT-2: Vision-Language-Action Models Transfer Web Knowledge to Robotic Control 웹 규모 데이터로 훈련된 비전-언어 모델, 로봇 제어에 혁신적 변화 가져와 구글 딥마인드(Google DeepMind) 연구팀이…

“로봇아, 커피 한잔 만들어줘” … 허깅페이스, 로봇에 말로 지시하는 파운데이션 모델 전격 공개

허깅페이스(Hugging Face)가 로봇을 자연어로 제어할 수 있는 비전-언어-액션 플로우 모델 ‘Pi0(파이제로)’를 오픈소스로 공개했다. 이는 로봇 제어 전문 기업 르로봇(LeRobot)이 개발한 최초의 공개형 로봇 제어…

[CES 2025]엔비디아, 영상도 보고 언어도 이해하는 ‘네모트론’ 모델군 공개… AI 에이전트 시대 연다

엔비디아가 CES 2025 키노트를 통해 기업용 에이전트형 AI 개발을 위한 ‘라마 네모트론(Llama Nemotron)’ 대규모 언어 모델군을 공개했다. 이는 6억 5천만 회 이상의 다운로드를 기록한…

![[CES 2025]엔비디아, 영상도 보고 언어도 이해하는 '네모트론' 모델군 공개... AI 에이전트 시대 연다](https://aimatters.co.kr/wp-content/uploads/2025/01/엔비디아-자료-1-1-300x168.jpg)