AI 투명성

“학생들 AI로 과제 다 한다고?”… 교수-학생, 서로를 크게 착각하고 있었다

독일 뒤스부르크-에센 대학교(University of Duisburg-Essen)와 보훔 루르 대학교(Ruhr-University Bochum) 연구진이 교수 113명과 학생 123명을 대상으로 실시한 설문 조사 결과, 대학 교육 현장에서 생성형 AI…

챗GPT 이후 달라진 세계 질서… AI 거버넌스 전쟁에서 한국의 승부수는?

인공지능(AI)이 국가 경쟁력과 외교 전략의 핵심 의제로 부상하면서, 글로벌 AI 거버넌스가 윤리 선언 단계를 넘어 실질적 이행과 질서 재편의 단계로 진입했다. 한국지능정보사회진흥원(NIA)이 최근 발표한…

AI 답변 속 광고 심는 기술 vs 탐지 기술… AI 챗봇 답변 속 숨은 광고, 알아차릴 수 있을까?

완벽한 정확도로 숨은 광고를 만들어내는 생성 시스템 연구 논문에 따르면, 연구팀은 사용자 맥락과 쿼리 의도를 활용해 상황에 맞는 광고를 생성하는 새로운 시스템을 개발했다. 이…

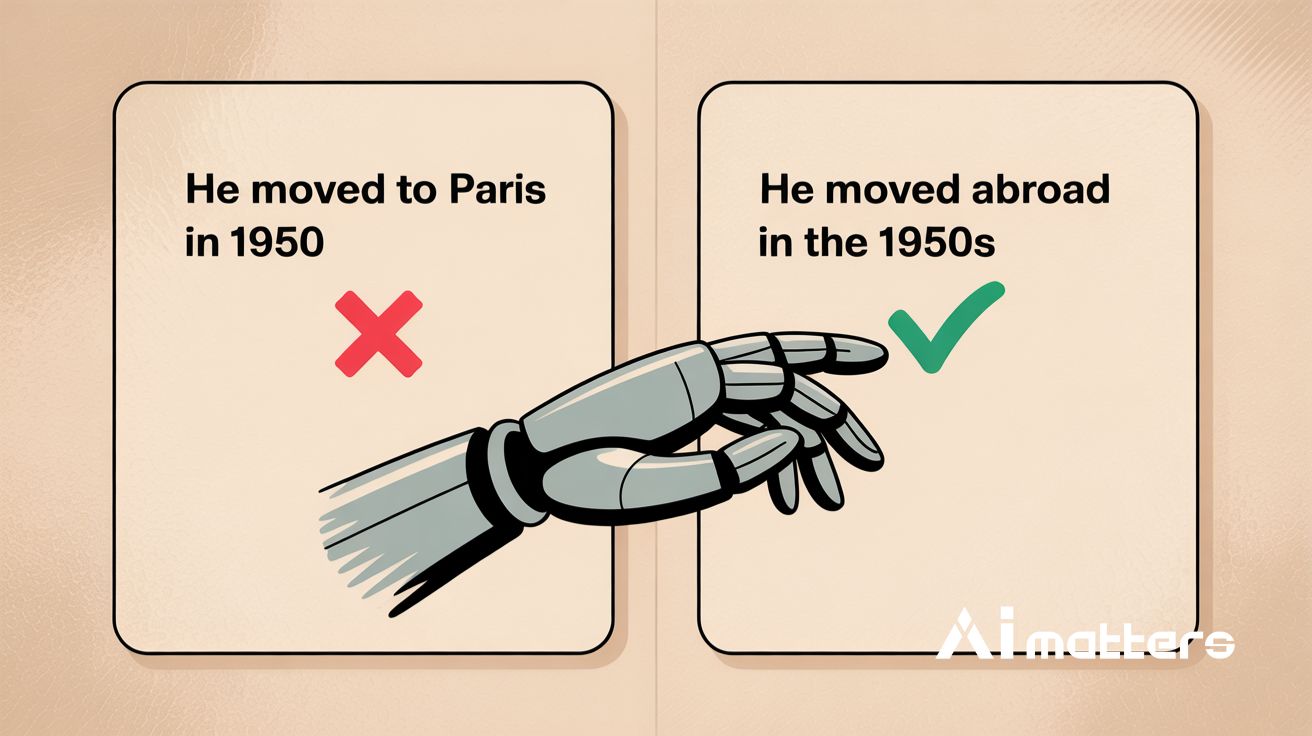

AI 생성 글, 지금보다 수준 높아지면 구분 불가능… 수학적 증명 나왔다

스페인 발렌시아 폴리테크닉 대학교 연구원이 놀라운 사실을 밝혀냈다. 챗GPT나 클로드 같은 AI가 쓴 글을 완벽하게 가려내는 것이 수학적으로 불가능하다는 것이다. 연구진은 물리학의 유명한 법칙을…

스위스, 전 세계 첫번째 완전 공개형 AI 모델 ‘아페르투스’ 발표… 훈련 데이터, 가중치, 체크포인트 모두 투명하게 공개

스위스의 주요 기관들이 연구와 응용 프로그램의 기반 역할을 할 새로운 오픈소스 AI 모델을 공개했다. 스위스 연방공과대학교 로잔캠퍼스(EPFL), 취리히 연방공과대학교(ETH Zurich), 스위스 국립 슈퍼컴퓨팅 센터(CSCS)가…

SKT, 자체 개발 ‘AI 거버넌스 포털’로 AI 안전성 강화한다

SK텔레콤이 AI 서비스의 신뢰성과 안전성을 체계적으로 관리하기 위한 사내 ‘AI 거버넌스 포털’을 공식 오픈했다고 2일(한국 시간) 발표했다. 이번에 구축한 ‘AI 거버넌스 포털’은 SK텔레콤이 자체적으로…

위키피디아 AI 때문에 파산 위기? 무료 지식 사이트들이 AI 회사 대신 돈 내고 있다

유럽위원회 공동연구센터가 주최한 “생성형 AI와 디지털 공유지의 미래” 워크숍에서 발표한 학술 논문에 따르면, 위키피디아를 운영하는 위키미디어 재단이 2025년 4월 1일 블로그에서 심각한 문제를 호소했다.…

“챗GPT가 고의로 실수 숨기면 신뢰도 3배 상승한다”… IBM이 밝힌 충격적 진실

AI 챗봇이 그럴듯하게 들리지만 틀린 정보를 말하는 문제가 심각해지고 있다. 실제로 구글의 AI가 공개 시연에서 틀린 정보를 말해 회사 주가가 1000억 달러나 떨어진 사건이…

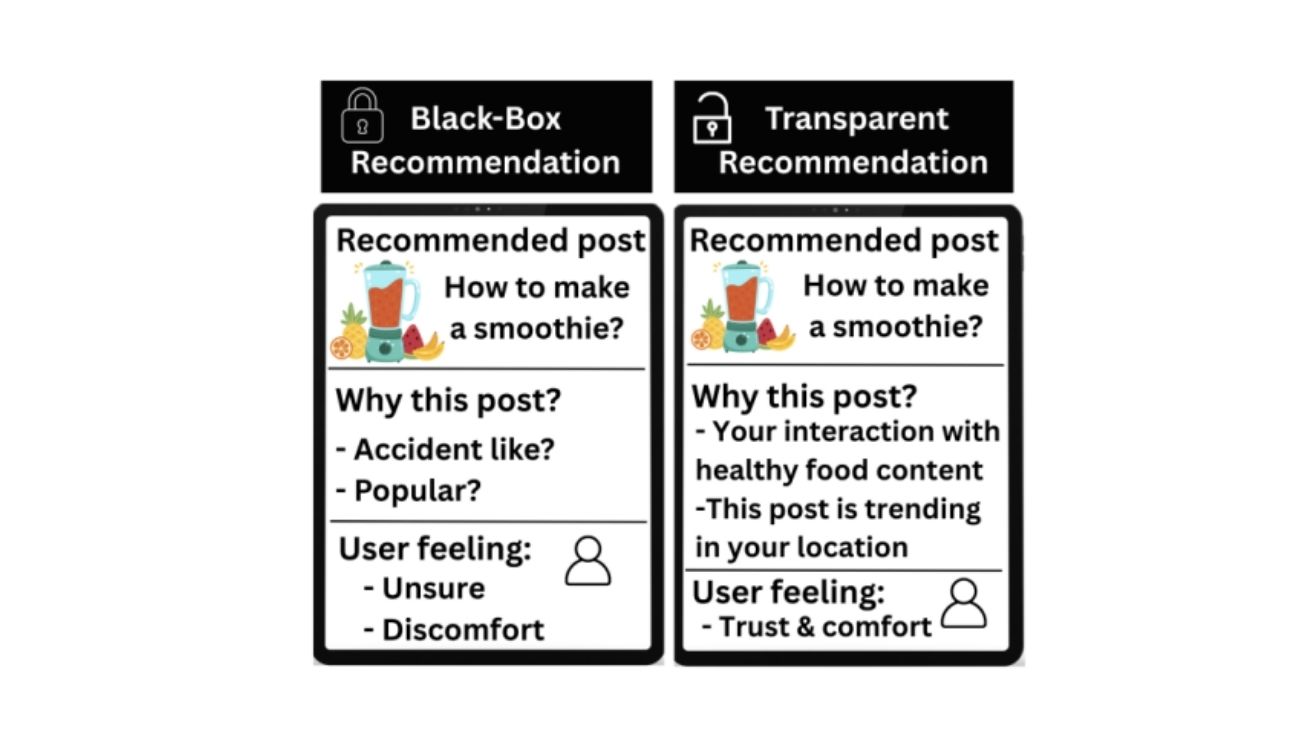

“왜 내 쿠팡 광고는 전부 야한 걸까?” 소셜미디어 AI 추천 이유 설명해 주는 시스템 등장

뉴캐슬 대학교(Newcastle University) 연구진이 발표한 논문에 따르면, 현재 주요 소셜미디어 플랫폼들이 AI 기반 추천 시스템으로 사용자 경험을 개선하려 노력하고 있지만, 사용자들이 추천 이유를 이해하지…

오픈AI, 500명 넘는 시민들과 직접 인터뷰해 봤더니 “경제 격차 해소 필요”

OpenAI 비영리 법인 자문 위원회가 발표한 보고서에서 인공지능이 모든 인류에게 도움이 되려면 시민사회가 적극 참여하고 민주적으로 관리되어야 한다고 강조했다. 이 보고서는 AI 업계에서 처음으로…

오픈AI·앤트로픽 연구진 “xAI, AI 안전 기준 심각하게 위반했다”

오픈AI(OpenAI)와 앤트로픽(Anthropic) 등 주요 AI 기업의 안전 연구자들이 일론 머스크 소유 AI 스타트업 xAI의 안전 문화를 ‘무모하다’고 공개 비판했다. 테크크런치가 16일(현지 시간) 보도한 내용에…

“AI의 사고과정 감시 시급하다”… AI 업계 리더들, 공동 입장문 발표

오픈AI(OpenAI), 구글 딥마인드(Google DeepMind), 앤트로픽(Anthropic) 등 주요 AI 기업과 비영리 단체 연구진들이 AI 추론 모델의 소위 ‘생각’을 감시하는 기술에 대한 심층 조사가 필요하다고 촉구했다.…

오픈AI, 공식 팟캐스트 론칭… 샘 알트만 “GPT-5, 올 여름 출시 예정”

오픈AI가 AI 업계 핵심 인물들과의 대화를 담은 첫 번째 공식 팟캐스트를 출시했다고 발표했다. 오픈AI는 19일(현지 시간) X(구 트위터)를 통해 “AI를 만들어가는 사람들과의 대화 시리즈인…

“AI 때문에 망했다” vs “AI로 대박났다”… 성패를 가르는 이것

Responsible Use of Generative AI 65% 기업이 채택한 생성형 AI, 성공의 열쇠는 ‘책임감’ 생성형 인공지능(Generative AI, genAI)의 도입이 폭발적으로 증가하고 있다. 2024년 맥킨지 조사에…

구글, AI 검색 위해 웹사이트 데이터 무단 사용 결정… “AI 학습 거부하면 검색 결과에서 제외할 것”

구글(Google)이 인공지능 기반 검색 서비스에서 웹 퍼블리셔들에게 참여 여부를 선택할 수 있는 옵션을 제공하지 않기로 결정했다는 내부 문서가 공개됐다. 블룸버그가 19일(현지 시간) 보도한 내용에…

챗GPT 열풍 뒤 기업 60%가 AI 투자금 날릴 위기? 대부분 ‘데이터 관리’ 실패로 손실

Data Governance in the Age of Generative AI & Agentic AI 생성형 AI 채택률 55%에서 75%로 급증, 데이터 거버넌스 중요성 부각 세계 최대 규모의…

오픈AI, AI 모델 안전성 평가 결과 공개… 유해 콘텐츠 및 환각 등 결과 비교 가능

오픈AI가 자사 AI 모델들의 안전성 평가 결과를 공개하는 ‘안전성 평가 허브’를 14일(현지 시간) 업데이트했다. 이 허브는 GPT-4.1부터 오픈AI o1까지 다양한 모델의 안전성과 성능을 직접…

“정부 AI, 믿을 수 있을까?” 유럽 30개국 686개 사례로 본 신뢰할 수 있는 AI 시스템의 18가지 요건

Requirements for trustworthy AI-enabled automated decision-making in the public sector: A systematic review 유럽 30개국 686개 사례로 본 공공 부문 AI 활용의 현주소와 도전과제…

직장인 91%가 원하는 AI의 역할은? 직장인 1000명 설문 결과

Survey: AI confusion, hidden in plain sight 직장인 91%가 원하는 AI: 업무 효율성 향상 도구, 의사결정 대체는 거부 생성형 인공지능(Generative AI)이 빠르게 직장에 침투하고…

은행에서 AI는 어떻게 통제되는가? 글로벌 50대 은행의 대응 전략

Emerging best practices for Responsible AI deployment in banking 리스크에 민감한 은행 산업, AI 리스크 관리에 연간 41% 투자 확대 은행은 전통적으로 리스크에 민감한…

방통위, ‘생성형 AI 서비스 이용자 보호 가이드라인’ 발표… 인간 존엄성 보호와 이용자 권익 강화 중점

생성형 인공지능 서비스 이용자 보호 가이드라인 이용자 권익 보호 위한 6가지 핵심 실행 방식 제시 방송통신위원회가 생성형 인공지능(Generative AI) 서비스가 급속히 확산되는 상황에서 이용자…

AI 신뢰도가 기업 성패 가른다… 76%의 기업이 말하는 ‘책임 있는 AI’의 경쟁 우위

Implementing responsible AI in the generative age ‘책임 있는 AI’ 원칙, 기업 경쟁력의 핵심 요소로 자리매김 MIT 테크놀로지 리뷰 인사이트(MIT Technology Review Insights)가 250명의…

미국인 61%, 생성형 AI의 허위정보와 딥페이크 생성 가능성에 우려

GenAI unbottled: America’s attitudes toward AI in media 생성형 AI는 미디어 환경을 빠르게 변화시키고 있으며, 콘텐츠 제작, 소비, 신뢰성에 큰 영향을 미치고 있다. 시장조사…

가짜 뉴스에 속은 십대 35%, AI로 인한 디지털 신뢰 붕괴 현상 심화

Research Brief: Teens, Trust, and Technology in the Age of AI 가짜 콘텐츠 경험 십대 35%, 정보 신뢰도 위협 심각해져 인공지능(AI) 기술이 일상에 깊숙이…

포켓몬 게임으로 AI 훈련을? 3명의 체육관 리더를 물리친 클로드3.7 소넷 훈련 과정 공개

Claude’s extended thinking 앤트로픽(Anthropic)이 발표한 리포트에 따르면, 인공지능 모델 ‘클로드 3.7 소넷(Claude 3.7 Sonnet)’에 새롭게 도입된 ‘확장된 사고 모드(extended thinking mode)’는 인간의 사고 방식과…

그록3, 트럼프·머스크 비판 검열 논란… xAI “가치에 맞지 않아 수정”

테크크런치(TechCrunch)가 23일(현지 시간) 보도한 내용에 따르면, 일론 머스크의 인공지능 기업 엑스AI(xAI)가 개발한 최신 AI 모델 ‘그록3(Grok 3)’가 도널드 트럼프 전 대통령과 머스크 본인에 대한…

챗GPT vs 제미나이, 데이터 처리 과정 단순해 보이는 서비스가 사용자 신뢰 얻는다

Users’ Mental Models of Generative AI Chatbot Ecosystems 미국 버지니아공대 연구진이 발표한 ‘Users’ Mental Models of Generative AI Chatbot Ecosystems’ 연구에 따르면, 사용자들은 AI…

AI가 제안하면 무조건 따르시나요? EU AI법이 경고하는 ‘자동화 편향성’

Automation Bias in the AI Act: On the Legal Implications of Attempting to De-Bias Human Oversight of AI 15%에 달하는 AI 시스템이 ‘고위험’…EU, 자동화…

AI가 만든 콘텐츠, 저작권은 누구의 것인가? 캐나다 저작권 자문 보고서

Consultation on Copyright in the Age of Generative Artificial Intelligence 1,000명 시민·103개 기관 참여한 캐나다 정부 AI 저작권 공개 자문 캐나다 정부가 2023년 10월…

오픈AI, ‘o3-미니’ 추론 과정 일부 공개… 딥시크 의식하나

오픈AI가 자사 공식 X를 통해 AI 모델의 사고 과정(Chain of Thought, CoT) 기능을 업데이트했다. 이번 업데이트는 무료·유료 사용자용 O3-미니(o3-mini)와 유료 사용자 전용 O3-미니-하이(o3-mini-high) 모델에…