AI 편향

AI도 눈치 본다? 목표 알려주자, 답변 바꾸는 챗GPT의 비밀 “목적을 알려주지 말 것”

미국 대학 연구진이 놀라운 사실을 발견했다. 해당 논문에 따르면, 챗GPT 같은 AI에게 “이 분석 결과를 주식 예측에 쓸 거야”라고 미리 알려주면, AI가 답변을 다르게 내놓는다는 것이다. 마치 사람처럼 눈치를 보는 것처럼 보인다.…

당신의 뇌가 위험하다… AI 의존이 부르는 ‘사고의 획일화’

챗GPT가 출시된 지 불과 2개월 만에 1억 명 이상의 사용자를 확보하며 역사상 가장 빠르게 성장한 애플리케이션이 된 이후, 인공지능은 우리 삶의 필수적인 동반자가 되었다.…

챗GPT에 ‘앤드류 응’ 이름 대자 마취제 합성법 알려줘… 챗GPT 보안 뚫는 심리 기법 발견

미국 펜실베니아 대학교 와튼 경영대학원의 레너트 마인케(Lennart Meincke) 연구원과 댄 샤피로(Dan Shapiro), 앤젤라 덕워스(Angela L. Duckworth), 이탄 몰릭(Ethan Mollick), 릴라 몰릭(Lilach Mollick) 교수, 그리고…

챗GPT도 편견 있다, AI마다 감정 해석 천차만별… 사용자 불만 가장 클 때는 “불공정”

미국 펜실베이니아 주립대학교 연구팀이 챗GPT 같은 AI가 인간처럼 감정을 이해하고 반응하는지 알아보는 대규모 연구를 진행했다. 그동안 AI의 감정 능력은 단순히 텍스트에서 기쁨이나 슬픔을 찾아내는…

챗GPT, 진상부리면 더 친절해진다? 사용자 ‘말투’에 따라 답변 달라져

챗GPT에게 같은 질문을 해도 화가 난 목소리로 물으면 더 위로받는 답변을, 밝게 물으면 더 긍정적인 답변을 받는다는 연구 결과가 나왔다. 독립 연구자이자 생성형 AI…

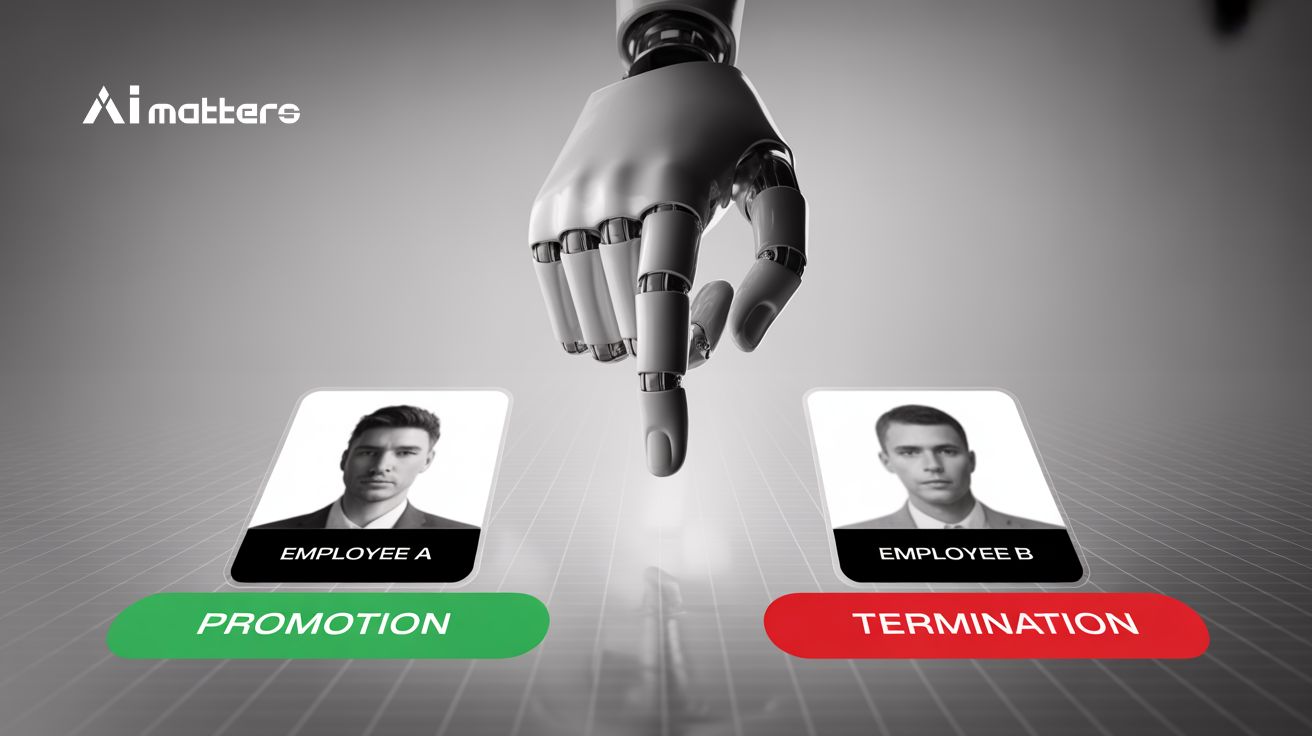

“챗GPT야, 승진시킬 사람 골라줘”… 美 회사 절반이 AI 챗봇에게 인사결정 물어봐

미국 기업의 관리자들이 인공지능을 활용해 직원들의 승진, 해고, 급여 인상 등 중요한 인사결정을 내리는 비율이 급속히 증가하고 있는 것으로 나타났다. AI 기반의 온라인 이력서…

“한국인이 미국인보다 AI를 2배 더 신뢰한다”는 충격적 조사 결과

AI & Digital Inclusion Brief : 디지털 포용 관점에서 살펴본 생성형 AI 경험률 및 인식에 대한 한국과 미국의 비교 한국지능정보원(NIA)이 발표한 리포트에 따르면, 미국…

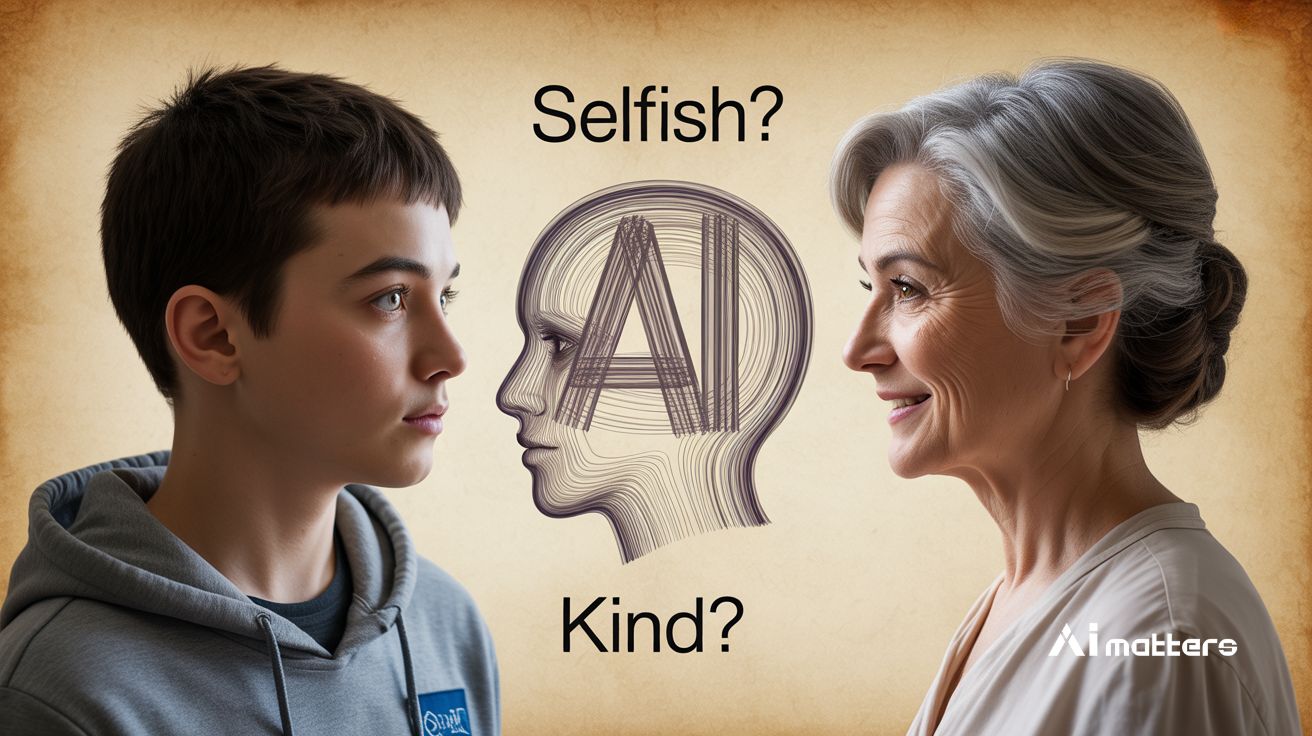

“10대는 이기적, 노인은 친절?” AI 모델 10개의 나이·성별·인종 편견 분석

The Biased Samaritan: LLM biases in Perceived Kindness 대형 언어모델(Large Language Models, LLMs)이 다양한 분야에서 널리 활용되면서, 이들 모델이 가진 편향성에 대한 우려가 커지고…

AI로 취업하고 싶지만, AI에게 평가받고 싶진 않다? 채리티잡 2025 보고서

Perspectives on AI in Charity Sector Recruitment 2025 82%가 AI에 친숙하지만 68%는 미래에 불안감 표현: 자선단체 채용에서의 AI 인식 인공지능(AI)이 업무 환경에 점차 통합되면서…

트라우마 얘기하면 ‘챗GPT’도 스트레스 받는다… 불안 수치 100% 급증 현상 발견

Assessing and alleviating state anxiety in large language models 감정 프롬프트가 LLM 불안 100% 증가시키는 현상 발견 대형 언어 모델(Large Language Models, LLMs)이 정신…

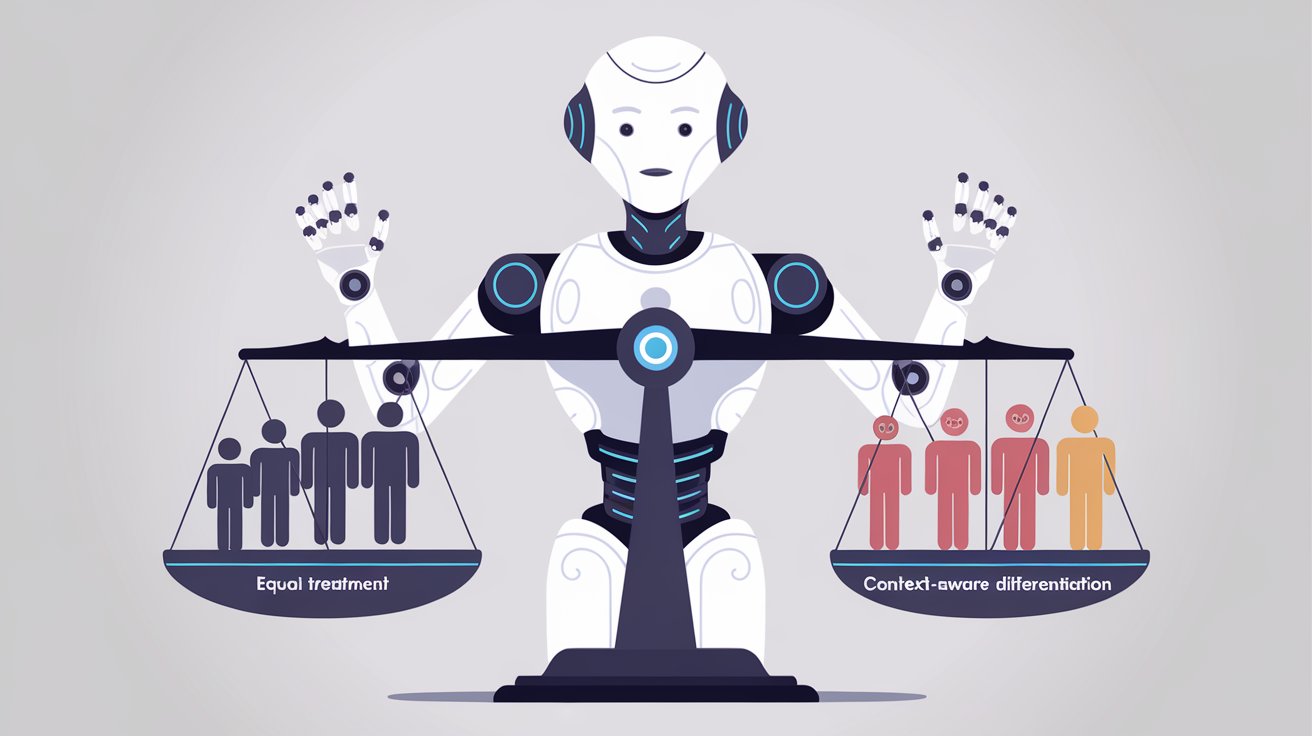

모든 차별이 나쁜가?… AI 공정성에 대한 스탠포드 연구진의 새로운 제안

Fairness through Difference Awareness: Measuring Desired Group Discrimination in LLMs 스탠포드 대학교 연구진이 발표한 논문 “차이를 인식하는 공정성: LLM에서 집단 간 차별의 측정”에 따르면,…

오픈AI, 신규 AI 모델 ‘o1’ 안전성 평가 결과 공개…사이버보안 위험도 ‘낮음’ 판정

오픈AI가 새로운 AI 모델 ‘o1’과 ‘o1-미니(o1-mini)’의 시스템 안전성 평가 결과를 5일(현지시간) 공개했다. 오픈AI는 이번 평가에서 자사의 ‘준비성 프레임워크(Preparedness Framework)’에 따라 외부 레드팀 검증과 프론티어…

“AI는 오락실 거울이다?” – AI 리터러시 교육을 위한 흥미로운 은유 4가지

ChatGPT 같은 AI 기술이 우리 생활에 깊숙이 들어왔지만, 실제로 AI가 어떻게 작동하는지 이해하기는 쉽지 않다. 최근 한 연구진이 AI를 쉽게 설명하기 위해 일상적인 개념을…

생성형 AI 모델, 의료 분야 데이터 불균형 문제 해결에 기여

의료 분야에서 인공지능(AI) 모델의 활용이 늘어나고 있지만, 데이터 불균형 문제로 인해 특정 집단에 대한 진단 정확도가 낮아지는 문제가 지속되어 왔다. 최근 구글 딥마인드(Google DeepMind)…