AI 환각 문제

AI, 냉장고 문도 제대로 못 닫는다… 퀄컴 연구진, AI 물리 인식 능력 테스트 결과 공개

퀄컴(Qualcomm) AI 연구팀이 최신 인공지능 모델들이 우리가 일상에서 하는 간단한 행동조차 제대로 이해하지 못한다는 사실을 밝혀냈다. 이번 연구는 이미지를 보고 텍스트를 이해하는 AI 모델들이…

미국 검찰, AI로 법원 서류 작성했다가 ‘가짜 판례’ 인용 논란

캘리포니아주 검찰이 형사 사건 법원 서류를 인공지능(AI)으로 작성했다가 존재하지 않는 판례를 인용한 사실이 드러났다. 가디언(The Guardian)이 26일(현지 시각) 보도한 내용에 따르면, 캘리포니아 북부 네바다…

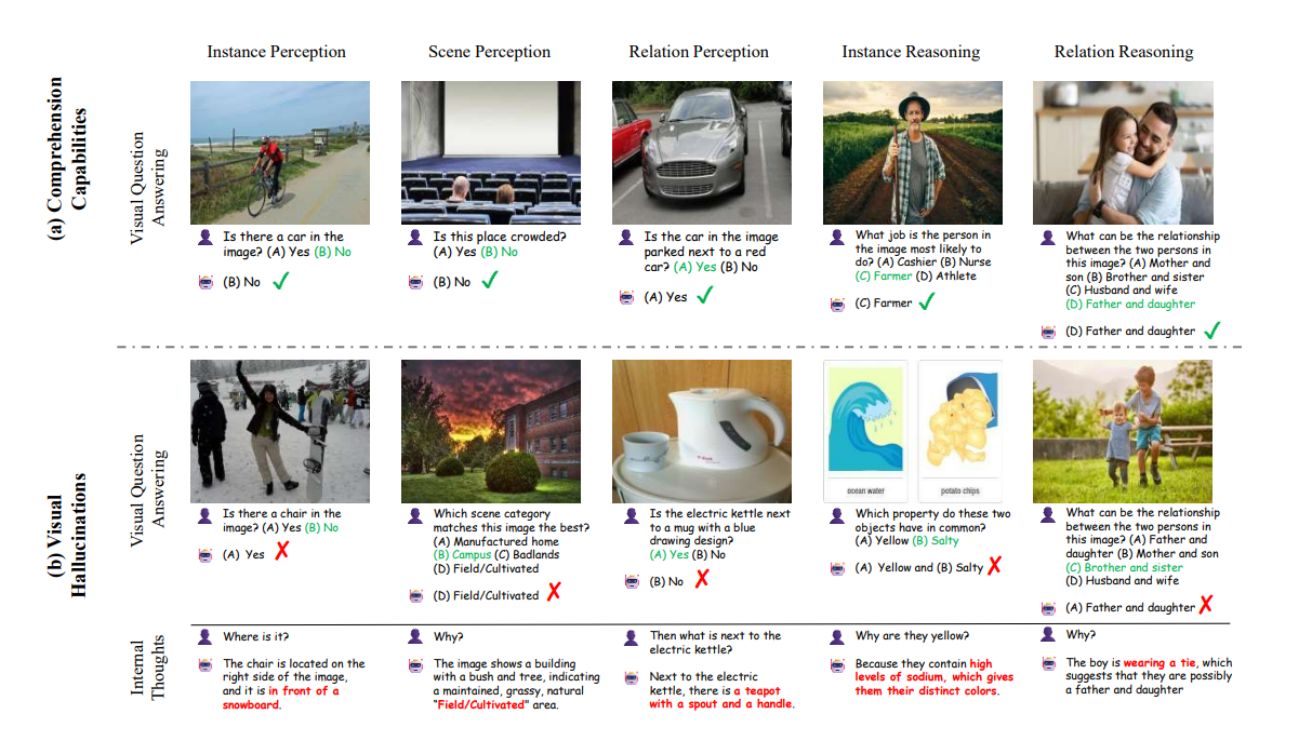

의료 진단 AI가 ‘가짜 종양’ 발견한다? 시각 AI 환각 현상의 충격적 진실

Visual hallucination detection in large vision-language models via evidential conflict 대규모 비전-언어 모델(LVLMs)이 텍스트와 이미지를 동시에 이해하는 놀라운 능력을 보여주고 있지만, 심각한 문제점이 발견되고…

예술용 AI는 편향되고, 기본 모델은 개선된다… 103개 모델 2년간 분석 결과 공개

EXPLORING BIAS IN OVER 100 TEXT-TO-IMAGE GENERATIVE MODELS 시간이 흐를수록 개선되는 기초 모델, 더 편향되는 예술 모델 텍스트-투-이미지(Text-to-Image, T2I) 생성 모델은 고품질 이미지를 합성할…

생성형 AI의 사실성 향상: 데이터 커먼스를 활용한 구글의 혁신

생성형 AI(Generative AI)는 최근 눈부신 발전을 이루고 있지만, 수치 데이터나 통계적 사실을 다룰 때 정확성이 떨어지는 ‘환각(hallucination)’ 현상이 주요 문제로 대두되고 있다. 이러한 한계를…