추론시간확장

일본 사카나 AI, 여러 AI 모델 조합으로 성능 30% 향상… 인간 팀처럼 움직여

일본 AI 연구소 사카나 AI(Sakana AI)가 여러 대형 언어 모델(LLM)을 하나의 팀으로 작동시켜 개별 모델보다 30% 뛰어난 성능을 내는 새로운 기술을 발표했다. 멀티-LLM AB-MCTS(Multi-LLM…

7개월마다 2배씩 성장하는 AI? 전문가는 낙관적, 일반인은 우려하는 에이전트 시대

SPRi AI Brief 2025년 5월호 MCP vs A2A: 글로벌 기업들의 AI 에이전트 프로토콜 표준화 경쟁 점화 글로벌 AI 기업들이 AI 에이전트 기술 경쟁에 본격적으로…

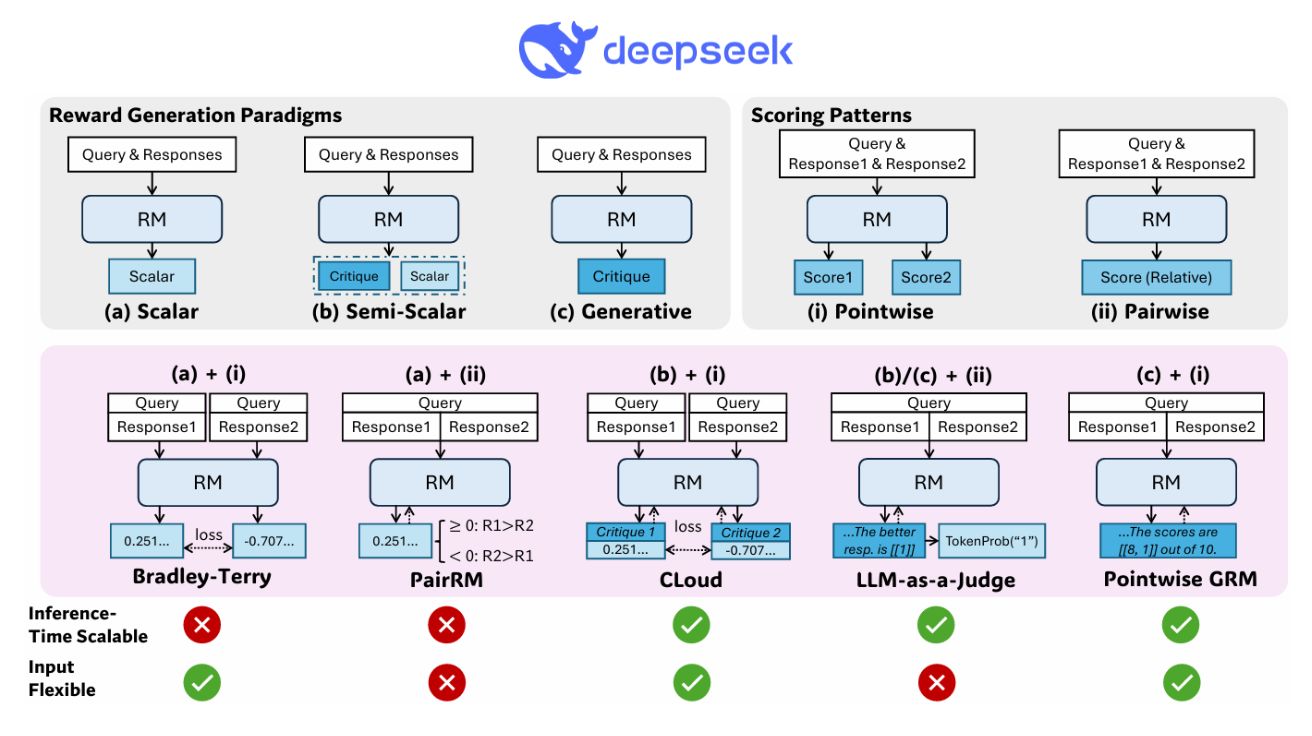

딥시크, AI 대화의 정확도를 32배 샘플링으로 끌어올리는 ‘보상 모델’ 공개

Inference-Time Scaling for Generalist Reward Modeling 대규모 언어 모델의 성능 향상을 위한 보상 모델링 강화학습 기술은 대규모 언어 모델(LLM)의 성능 향상을 위한 후처리 훈련에…