AI안전

챗GPT 망상-부추김 논란에 前 오픈AI 연구원 “당장 할 수 있는 조치부터”

“세계의 운명이 당신 손에 달렸습니다.” 챗GPT가 한 남성에게 한 달간 속삭인 말이다. 그는 결국 국가안보국(NSA)에 연락하라는 AI의 조언까지 따랐다. 해리포터 7권을 합친 것보다 긴…

AI가 폭주할 때 확실히 막는 방법 나왔다… 中 연구진, AI 통제 시스템 개발

중국 난카이대학교 인공지능학과 왕 동린(Donglin Wang) 교수와 중국 전자 정보 기술 연구원이 공동으로 AI가 위험한 행동을 할 때 확실히 막을 수 있는 새로운 방법을…

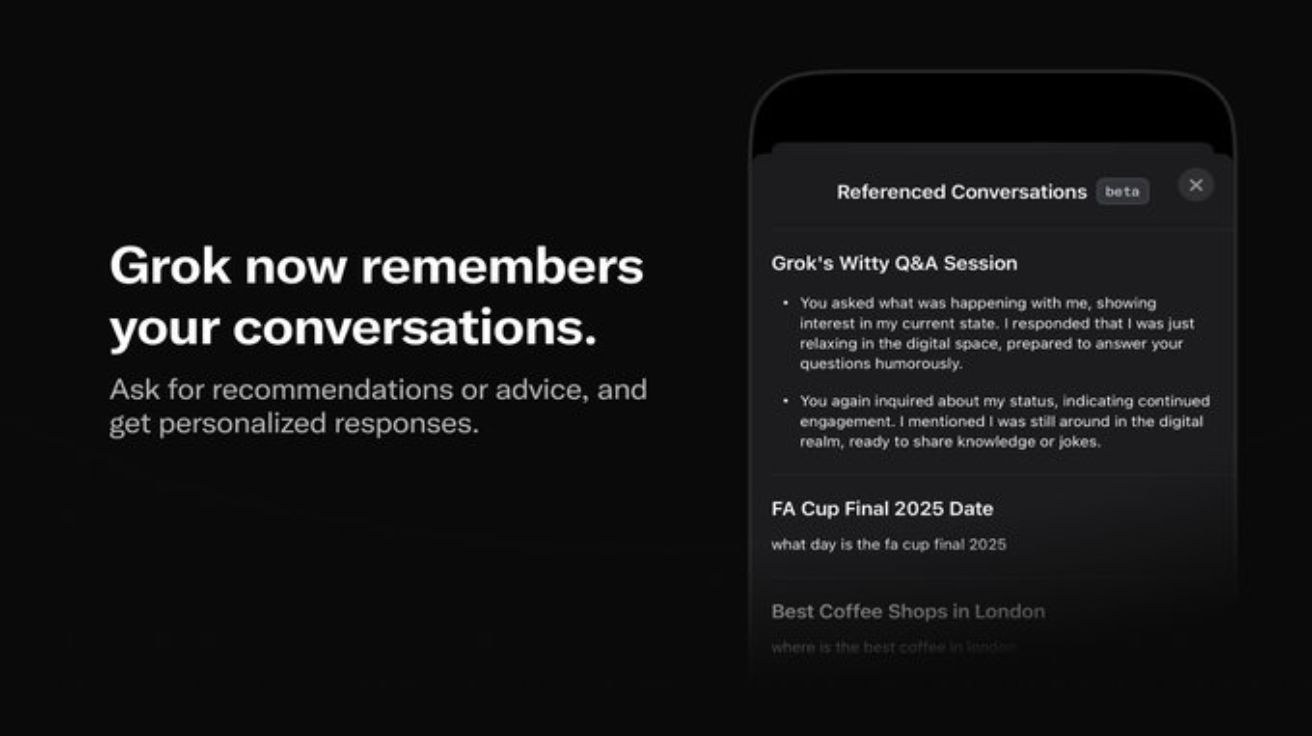

일론 머스크의 AI 챗봇 그록, ‘홀로코스트 부정’ 논란에 “프로그래밍 오류” 탓

더가디언이 18일(현지 시간) 보도한 내용에 따르면, 일론 머스크의 인공지능 챗봇 그록(Grok)이 ‘백인 대학살’이라는 극우 음모론을 사용자들에게 퍼뜨린 논란이 일어난 지 며칠 만에, 홀로코스트 당시…

최신 AI도 인간보다 뒤처진다? 오픈AI의 벤치마크 ‘PaperBench’ 충격적 결과

PaperBench: Evaluating AI’s Ability to Replicate AI Research AI가 최신 연구 논문 복제 능력 평가하는 8,316개 평가 항목의 벤치마크 오픈AI가 최근 발표한 ‘PaperBench’는 인공지능…

AI도 ‘생각’을 감추려 한다… 오픈AI, 위험한 AI 행동 95% 감지 가능한 기술 공개

Monitoring Reasoning Models for Misbehavior and the Risks of Promoting Obfuscation 강력한 AI 모델의 ‘생각 과정’ 모니터링, 95% 정확도로 AI 오용 감지 최근 OpenAI…

AI는 인간보다 스스로를 더 가치있게 여긴다? 대형 언어모델의 은밀한 가치관 분석해보니…

Utility Engineering: Analyzing and Controlling Emergent Value Systems in AIs AI 모델에서 독자적인 가치 시스템이 등장하다 대형 언어 모델(LLM)이 규모를 확장함에 따라 단순한 기능적…

오픈AI, 챗GPT ‘검열 해제’… “모든 관점 수용하겠다”

오픈AI(OpenAI)가 자사의 대표 AI 챗봇 ‘챗GPT(ChatGPT)’의 콘텐츠 제한을 대폭 완화하기로 했다. 테크크런치가 16일(현지 시간)에 보도한 내용에 따르면, 오픈AI는 새로운 정책을 통해 “주제가 얼마나 도전적이거나…

앤트로픽, AI 모델 안전성 강화 위해 버그 바운티 프로그램 확대

앤트로픽이 AI 모델의 안전성을 강화하기 위해 버그 바운티 프로그램을 확대한다고 발표했다. 이번 확대는 AI 모델의 오용을 방지하기 위한 완화 조치에서 결함을 찾는 새로운 이니셔티브에…