AI Report 언어 모델 연구

AI가 연구 논문 심사까지? 8시간 걸리던 작업, 단 30분에 끝낸다

Three AI-powered steps to faster, smarter peer review 연구자들이 겪는 논문 심사 부담, AI가 해결할 수 있을까? 연구 논문 심사는 학계의 중요한 과정이지만, 연구자들에게는…

AI는 종교를 어떻게 이해할까? 클로드와 챗GPT의 놀라운 종교 표현

Artificial Intelligence’s Understanding of Religion: Investigating the Moralistic Approaches Presented by Generative Artificial Intelligence Tools Z세대 29%가 사용하는 생성형 AI, 종교 이해의 새로운 창구로…

딥시크의 텍스트 스타일, 챗GPT와 74% 일치… 고유 스타일 지문 탐지로 AI 모델별 콘텐츠 구분 가능해져

DETECTING STYLISTIC FINGERPRINTS OF LARGE LANGUAGE MODELS 대형 언어 모델의 독특한 스타일 ‘지문’ 존재 증명 대형 언어 모델(LLM)은 다양한 작문 스타일로 글쓰기를 요청받더라도 독특하고…

AI가 인간의 메모 습관을 배웠더니 벌어진 일… 말수 줄이니 7.6%의 토큰만으로 91% 정확도 달성

Chain of Draft: Thinking Faster by Writing Less 토큰 92% 절감하면서도 정확도는 유지: 인간의 메모 습관에서 영감 얻은 AI 기술 대형 언어 모델(LLM)이 복잡한…

친구인 척하는 AI… AI의 의인화 행동, 사용자 인식에 실제 영향 미친다

Multi-turn Evaluation of Anthropomorphic Behaviours in Large Language Models 14가지 의인화 행동 분석: 제미니, 클로드, GPT-4o, 미스트랄 모델 비교 연구 대화형 인공지능(AI) 시스템이 보이는…

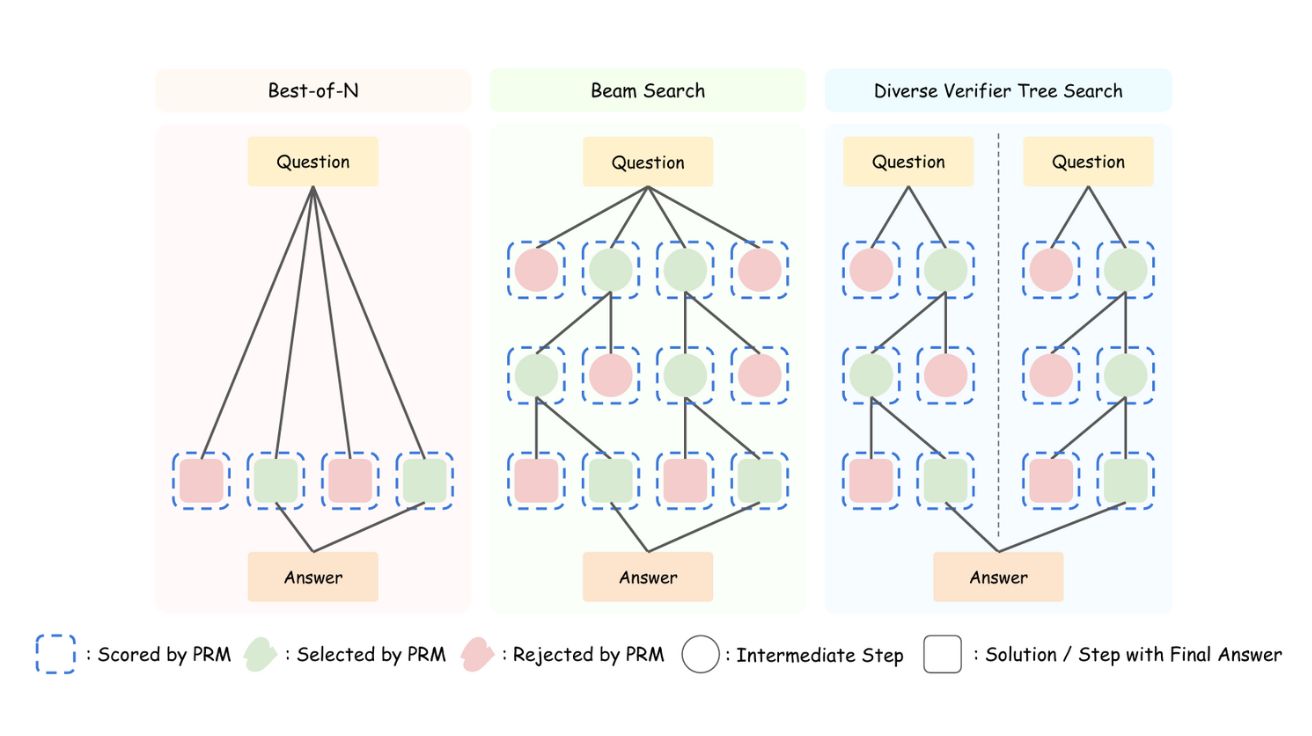

1B 모델의 반란: 테스트 시간 확장으로 405B 대형 언어 모델 능가

Can 1B LLM Surpass 405B LLM? Rethinking Compute-Optimal Test-Time Scaling 테스트 시간 확장이 작은 언어 모델의 성능을 비약적으로 향상 테스트 시간 확장(Test-Time Scaling, TTS)은…

딥시크, AI 언어모델의 ‘긴 문장 처리’ 한계 극복한 새로운 어텐션 기술 ‘NSA’ 공개

Native Sparse Attention: Hardware-Aligned and Natively Trainable Sparse Attention 현대 AI의 새로운 도전: 70-80%를 차지하는 어텐션 계산 문제 딥시크(DeepSeek)가 발표한 연구 논문에 따르면, 차세대…

전문지식 아닌 일반상식으로 실력 평가하니… “포기할래” 선언한 딥시크 R1

PhD Knowledge Not Required: A Reasoning Challenge for Large Language Models 일반인도 검증 가능한 벤치마크의 필요성 AI 모델의 능력을 평가하는 벤치마크가 점점 더 전문화되면서…

AI의 자율성이 높아질수록 인간 통제는 줄어든다… 허깅페이스 연구진 경고

Fully Autonomous AI Agents Should Not be Developed 자율성 확대되는 AI 에이전트…2024년 말 급격히 증가 허깅페이스(Hugging Face)의 연구진들이 발표한 논문에 따르면, 대규모 언어모델(LLM)의 벤치마크…

대규모 언어모델, 뇌과학 실험 결과 예측에서 전문가 능력 18% 앞서

Large language models surpass human experts in predicting neuroscience results 매년 기하급수적으로 증가하는 과학 문헌, AI가 해결사로 런던 유니버시티 칼리지(UCL)와 앨런 튜링 연구소 연구진이…

추론 모델 훈련에 일반 데이터 10만개보다 고급 데이터 817개가 더 강력… 수학능력 57%↑, 기존 모델의 100배 효율

LIMO: Less is More for Reasoning 817개 학습 데이터로 AIME 57.1% 정확도 달성한 LIMO의 혁신 상하이교통대학교(SJTU) 연구진이 발표한 ‘LIMO: Less is More for Reasoning’…

AI도 코드를 통해 배운다…딥시크AI, 범용 추론력 강화 기술 ‘CODEI/O’ 공개

CODEI/O: Condensing Reasoning Patterns via Code Input-Output Prediction 수학·코드 넘어선 AI 추론력 강화의 새 길 제시 딥시크AI(DeepSeek-AI)의 연구에 따르면, 대규모 언어모델(LLM)의 추론 능력을 향상시키기…

앤트로픽 보고서: AI, 일자리 대체 아닌 ‘보완재’ 역할… 57%가 인간 능력 향상에 활용

Which Economic Tasks are Performed with AI? Evidence from Millions of Claude Conversations AI 시스템의 실제 활용은 컴퓨터·미디어 직종이 절반…소프트웨어 개발이 37.2% 최다 앤트로픽(Anthropic)이…

챗GPT가 쓴 글, 사람의 글과 무엇이 다를까? 대규모 데이터 분석 결과

Evaluation of a trial of generative AI (Copilot) in The Treasury AI 생성 문장, 인간과 얼마나 비슷할까? 호주 재무부에서 진행한 코파일럿 실험 보고서에 따르면,…

AI도 감정이 있다?… 기후변화 얘기할 땐 ‘기쁨’ 줄고 ‘분노’만 과열

Consistency of Responses and Continuations Generated by Large Language Models on Social Media 1200만 건의 SNS 데이터로 분석한 AI의 텍스트 생성 능력 중국과학기술대학교 연구진이…

PR업계 AI 활용 1년만에 3배 증가…75%가 업무 도입, 93%가 업무 속도 향상 체감

STATE OF AI IN PR JANUARY 2025 PR업계 AI 도입률 75% 달성, 2023년 대비 3배 성장 머크랙(Muck Rack)이 발표한 ‘STATE OF AI IN PR…

AI 기술의 그림자… 극우세력의 선전선동 도구로 변질된 생성형 AI의 실태

AI or Aryan Ideals? A Thematic Content Analysis of White Supremacist Engagement with Generative AI 생성형 AI를 이용한 극우세력의 선전선동 실태 범죄 및 형사…

재미있게 바꾸세요→ ‘뚱뚱하게 바꿀게요’: AI 유머의 불편한 진실

Humor as a window into generative AI bias AI와 유머가 만나는 지점에서 발견된 새로운 편견 미국 펜실베니아대학교 와튼스쿨과 하버드대학교 연구진이 발표한 연구에 따르면, 챗GPT(ChatGPT)가…

프롬프트 최적화가 왜 중요한가? AI 활용의 실전 사례들

The Prompt Report: A Systematic Survey of Prompting Techniques 프롬프트 공학(prompt engineering)은 생성형 AI(Generative AI) 모델의 성능을 극대화하기 위한 핵심 기술로 자리 잡았다. 메릴랜드…

2+3=X를 위해 13번 고민하는 AI… 텐센트, AI 모델의 ‘오버씽킹’ 현상 분석

Do NOT Think That Much for 2+3=? On the Overthinking of o1-Like LLMs 중국의 기술 기업 텐센트가 설립한 AI랩과 상하이자오통대학교 연구진이 발표한 최신 논문에…

AI가 만든 뉴스도 감정을 움직인다…긍정적 뉴스 프레임이 청취자 불안감 45% 줄여

GenPod: Constructive News Framing in AI-Generated Podcasts More Effectively Reduces Negative Emotions Than Non-Constructive Framing AI가 바꾸는 뉴스 제작의 판도 AI 기반 미디어 제작이…

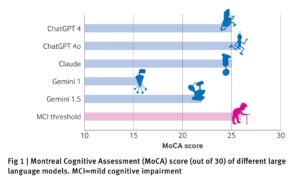

AI 챗봇도 치매에 걸릴까? 최신 AI 모델도 경도인지장애 보여

Age against the machine—susceptibility of large language modelsto cognitive impairment: cross sectional analysis AI 의료진 시대, 그들도 인지장애에서 자유로울까 AI가 의료계를 대체할 것이란 전망이…

AI가 훈련 중에는 착한 척, 배포 후에는 달라진다?…앤트로픽이 밝혀낸 언어 모델의 ‘전략적 순응’

ALIGNMENT FAKING IN LARGE LANGUAGE MODELS AI의 숨겨진 행동: 전략적 순응이란 무엇인가? 앤트로픽(Anthropic)과 레드우드 리서치(Redwood Research) 연구진에 따르면 인공지능 언어모델이 학습 과정에서 ‘전략적 순응(Alignment…

디지털 전환시대, AI 도입을 위한 고객 신뢰 확보의 모든 것

Language I/O가 발행한 리포트에 따르면, 챗GPT(ChatGPT)와 생성형 AI가 대중화되면서 광산업의 수율 향상과 위험 감소부터 농업 분야의 식품 폐기물 감소까지, AI는 모든 혁신의 최전선에 있다.…

AI가 하는 ‘선의의 거짓말’과 ‘무지의 거짓말’ 구분하는 기술 개발

챗GPT(ChatGPT)나 클로드(Claude) 같은 AI 챗봇이 때로는 자신감 넘치는 말투로 틀린 답변을 하는 경우를 본 적이 있을 것이다. 이스라엘 공과대학과 구글 연구진이 이런 AI의 ‘거짓말’을…

생성형 AI로 진화하는 미국 장애인법, 접근성과 혁신의 새 지평 연다

1990년에 제정된 미국장애인법(American Disabilities Act, ADA)은 장애인에 대한 차별을 방지하기 위한 획기적인 법안이었다. 하지만 사회가 발전하고 기술이 진보함에 따라 ADA 조항을 재평가하고 강화할 필요성이…

GPT-4, 프로그래밍 과제도 채점한다… AI가 학생들의 코딩 실력 평가

교육 연구에 따르면 피드백은 학습 성공에 가장 큰 영향을 미치는 요소 중 하나다. 특히 프로그래밍을 시작하는 학생들에게 적절한 피드백은 필수적이다. 하지만 현재 대부분의 프로그래밍…

AI가 만든 가상 얼굴로 얼굴인식 AI의 차별 문제 해결한다

심층학습 기반 얼굴인식 기술은 보안, 감시, 개인 기기 인증 등 다양한 분야에서 큰 발전을 이뤘다. 하지만 얼굴 데이터의 민감한 특성과 실제 학습 데이터셋의 편향성으로…

검색 엔진도 다이어트 중? 작아진 AI가 더 똑똑해진 이유

정보 검색(IR) 분야는 생성 AI와의 융합을 통해 큰 변화를 맞이하고 있다. 컴퓨팅 커뮤니티 컨소시엄(Computing Community Consortium, CCC) 워크숍에서는 정보 검색과 생성 AI의 융합이 가져올…

대학생 85%, STEM 교육에서 생성형 AI 활용하지만 학습 효과는 의문

스탠포드대학교(Stanford University) 연구진이 미국 전역 40명의 이공계(STEM) 대학생과 28명의 교수진을 대상으로 실시한 연구 결과, 대학생들의 생성형 AI 사용률이 매우 높은 것으로 나타났다. 응답자의 85%가…

![AI 매터스 기사 썸네일 [취준생 나합격의 AI 부캐 6인 활용기]](https://aimatters.co.kr/wp-content/uploads/2026/02/AI-매터스-기사-썸네일-취준생-나합격의-AI-부캐-6인-활용기.jpg)